AI Агенты -

OpenClaw на GitHub: репозиторий, релизы и установка из исходников

OpenClaw на GitHub — это самый практичный путь быстро понять архитектуру проекта, проверить релизы, собрать агент из исходников и подключить его к своим LLM-провайдерам, Telegram и локальному Ollama. Если вы ищете nemoclaw github , то правильная стратегия — начать с официального

OpenClaw на GitHub — это самый практичный путь быстро понять архитектуру проекта, проверить релизы, собрать агент из исходников и подключить его к своим LLM-провайдерам, Telegram и локальному Ollama. Если вы ищете nemoclaw github, то правильная стратегия — начать с официального репозитория, затем сверить README, теги релизов и переменные окружения, а уже после этого переходить к Docker, npm или ручной установке из source.

На практике именно GitHub-репозиторий отвечает на большинство прикладных вопросов: какие есть версии, как устроены Gateway (точка входа для управления агентом), Skills (расширения/навыки), какой CLI нужен, как включить Telegram pairing (сопряжение с Telegram) и какие провайдеры моделей поддерживаются. Ниже — подробный разбор установки на Windows, macOS и Linux, развёртывания через Docker и на VPS, типичных ошибок и безопасной схемы работы с токенами и внешними API. Актуальность версий, API и цен проверяйте в официальной документации на дату публикации.

Что такое OpenClaw на GitHub и зачем смотреть репозиторий перед установкой

GitHub-репозиторий OpenClaw — это не просто исходники, а центральная точка, где обычно находятся README, инструкции по запуску, примеры конфигурации, список релизов и часто — заметки о совместимости с провайдерами. Для self-hosted ИИ-агента это особенно важно: ошибка на этапе выбора версии или способа запуска потом обходится дороже, чем 10 минут, потраченные на изучение репозитория. Если вам нужен nemoclaw github, сначала убедитесь, что вы открыли официальный проект, а не зеркало, форк или стороннюю обёртку.

Какие данные брать именно из GitHub

Сначала смотрите README, затем раздел Releases, после этого — issue tracker и обсуждения, если они доступны. В README обычно лежат базовые команды установки, а в релизах — важные изменения в Gateway, CLI, форматах конфигурации и совместимости с провайдерами LLM. Практика показывает, что критичные различия между версиями часто не видны в маркетинговом описании, но отлично отражены в changelog.

Если проект использует теги версий, ориентируйтесь на них при установке из исходников или через npm. Если есть Docker-образы, проверьте, соответствуют ли они релизу, а не ветке main. Для агентских систем это особенно важно, потому что поведение Skills, маршрутизация запросов и параметры Gateway могут меняться между сборками.

Для кого подходит OpenClaw

OpenClaw особенно полезен тем, кто хочет собрать личного ИИ-ассистента на своём железе или на выделенном VPS и при этом не зависеть от одного облачного вендора. Это хороший вариант для разработчиков, энтузиастов self-hosted AI и тех, кому нужен Telegram-бот с интеграцией в локальные модели через Ollama или в облачные API через OpenAI API, Anthropic, Google Gemini и OpenRouter. Если нужен полностью управляемый стек, GitHub-репозиторий — лучший старт.

docs/, examples/ или skills/. Это обычно самые полезные источники для первичной настройки.

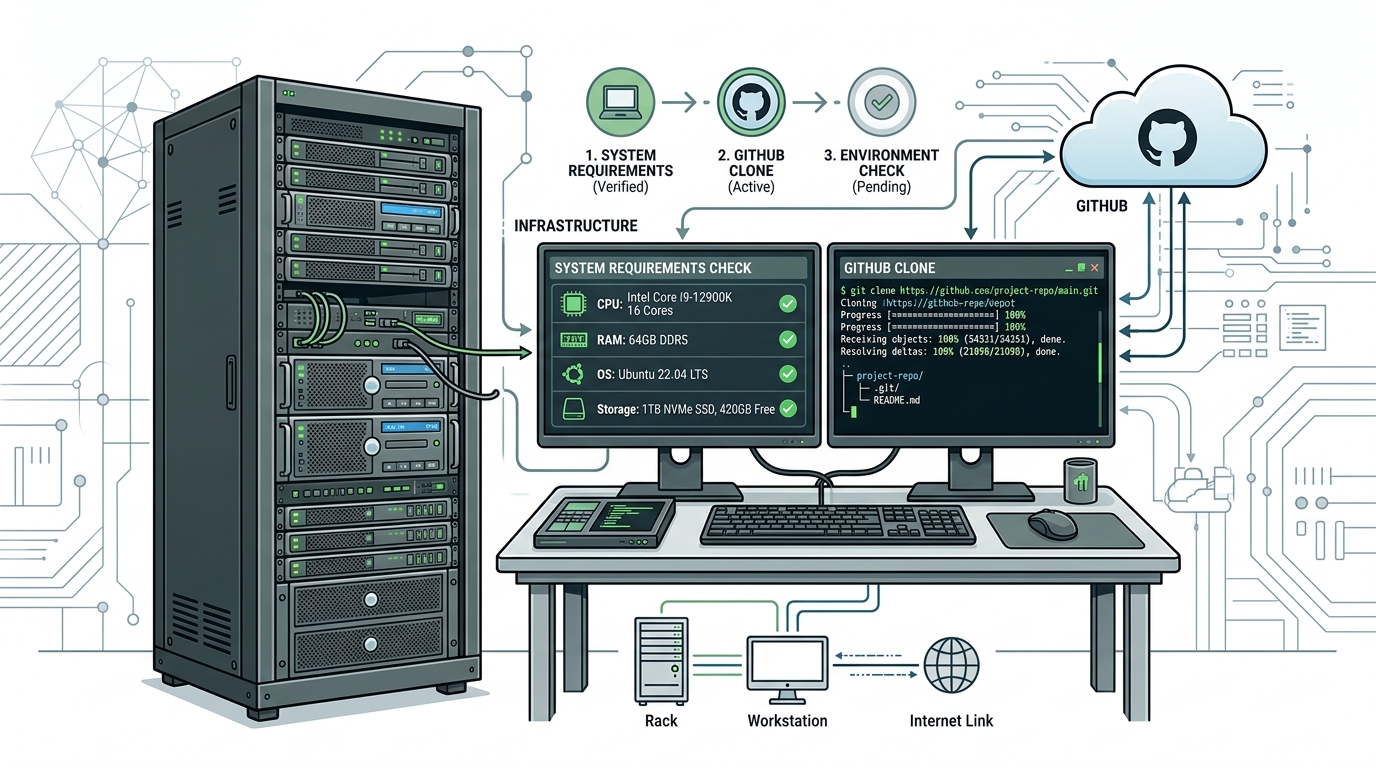

Подготовка к установке: системные требования, GitHub clone и проверка окружения

Перед установкой важно понять, как именно вы будете запускать OpenClaw: через Docker, как Node.js-проект, из исходников после сборки или на VPS как сервис. От этого зависят и зависимости, и набор команд, и способ хранения секретов. На практике я рекомендую сначала пройти минимальную проверку окружения: Git, Node.js, npm, Docker, доступ к Telegram Bot API и один провайдер LLM — хотя бы локальный Ollama.

Минимальный набор инструментов

Для установки из исходников обычно нужны Git, Node.js актуальной LTS-ветки, npm или другой пакетный менеджер, а также Docker, если проект поставляется с контейнеризацией. Для локального запуска моделей через Ollama понадобятся установленный сервис Ollama и хотя бы одна модель, которая влезает в вашу память и VRAM. Если планируете Telegram-интеграцию, заранее создайте бота через BotFather и сохраните токен в безопасном месте.

- Git — чтобы клонировать репозиторий.

- Node.js и npm — если проект собирается или запускается как JS/TS-приложение.

- Docker / Docker Compose — если удобнее поднимать сервисы контейнерами.

- Ollama — для локальных моделей.

- Telegram Bot Token — для pairing и получения сообщений.

- API keys — OpenAI, Anthropic, Gemini, OpenRouter или другие провайдеры.

Клонирование репозитория с GitHub

Базовый сценарий выглядит так: вы клонируете официальный репозиторий, переходите в папку проекта и читаете инструкцию по установке. Если есть релизный тег, лучше переключиться на него, а не работать с основной веткой, особенно если нужна воспроизводимая сборка. Это снижает риск поймать несовместимость между конфигурацией и кодом.

git clone https://github.com/<owner>/<repo>.git

cd <repo>

git checkout <release-tag>Точный URL, имя владельца и репозитория зависят от официального проекта OpenClaw — сверяйтесь с GitHub и README. Если в репозитории есть npm-пакет, то там же обычно указаны команды npm install, npm run build и npm start либо аналогичные. Если используется monorepo, обратите внимание на рабочие папки и package scripts.

Чек-лист перед первым запуском

| Параметр | Что проверить | Зачем это нужно |

|---|---|---|

| Версия Node.js | Совместимость с README | Избежать ошибок сборки |

| Docker | Доступен ли daemon | Запуск контейнеров и зависимостей |

| Telegram Bot Token | Создан ли бот через BotFather | Для pairing и входящих сообщений |

| LLM provider | Ключи и endpoint | Для генерации ответов агента |

| Порты | Не заняты ли Gateway/веб-интерфейс | Чтобы сервис стартовал без конфликта |

Установка OpenClaw на Windows, macOS и Linux: практические сценарии

Установка на разных ОС отличается не столько логикой, сколько деталями: пути, менеджеры пакетов, права доступа и способ работы с сервисами. Если OpenClaw поставляется как Node.js-проект, то на Windows часто удобнее использовать PowerShell или Windows Terminal, а на macOS и Linux — обычный shell. В любом случае главная цель — добиться предсказуемого запуска Gateway и корректной загрузки переменных окружения.

Windows: PowerShell, Node.js и переменные окружения

На Windows проверьте, что Node.js установлен корректно и доступен в PATH. Для многих self-hosted проектов удобно использовать .env-файл в корне проекта, а затем запускать приложение через npm script или Docker Desktop. Если проект требует нативных зависимостей, устанавливайте инструменты сборки заранее, иначе получите ошибки на этапе npm install.

node -v

npm -v

git --version

npm install

npm run build

npm startЕсли проект запускается через Docker, убедитесь, что Docker Desktop не блокируется политиками системы и что включена поддержка WSL2, если она требуется. На практике именно Windows чаще всего даёт проблемы с путями к файлам, кавычками в env-переменных и переносами строк в .env. При ошибках запуска сначала проверяйте синтаксис переменных и кодировку файла.

macOS: Homebrew, права и локальный запуск

На macOS обычно удобнее всего ставить Git, Node.js и Docker через Homebrew или официальные установщики. Если вы используете Ollama, проверьте, что сервис стартует и отвечает локально до подключения OpenClaw. Это резко ускоряет отладку: вы сразу понимаете, проблема в модели, в конфигурации OpenClaw или в Gateway.

brew install git node

git clone https://github.com/<owner>/<repo>.git

cd <repo>

npm install

cp .env.example .env

npm startНа macOS не игнорируйте права доступа к файлам, особенно если проект пишет логи или использует директории в ~/Library или внутри домашней папки. Если Telegram pairing не работает, отдельно проверьте, не блокируется ли исходящий доступ к API и правильно ли указан токен бота. Локальный firewall и корпоративные прокси иногда ломают даже простую webhooks/long polling схему.

Linux: systemd, Docker и запуск как сервис

Linux — самый удобный вариант для постоянной работы агента, особенно на домашнем сервере или VPS. Здесь проще всего упаковать OpenClaw в systemd-сервис или Docker Compose и автоматически поднимать его после перезагрузки. Если проект не содержит готового unit-файла, его легко написать вручную, но сначала стоит убедиться, что ручной запуск уже работает.

git clone https://github.com/<owner>/<repo>.git

cd <repo>

npm ci

cp .env.example .env

npm run startЕсли используете VPS, не открывайте Gateway в интернет без ограничений доступа, особенно если он позволяет выполнять административные действия. Лучше сначала привязать сервис к localhost, затем настроить reverse proxy, TLS и basic auth или иной слой авторизации. Для self-hosted AI-агента безопасность не менее важна, чем функциональность.

Gateway, CLI и конфигурация: как устроить управление агентом

Gateway — это точка входа для управления агентом: через него вы обычно конфигурируете поведение, подключаете каналы, провайдеров и Skills. CLI нужен для инициализации проекта, запуска локальных команд, отладки и, возможно, администрирования зависимостей. Даже если вы предпочитаете Docker, понимание CLI-слоя помогает быстрее находить причину сбоев.

Переменные окружения и файл .env

Практически во всех self-hosted проектах секреты и параметры хранятся в .env. Для OpenClaw логика обычно та же: в файле вы указываете токены, URL провайдеров, модель по умолчанию, настройки Gateway и каналы доставки сообщений. Точные имена переменных зависят от версии проекта, поэтому копируйте их из .env.example или документации.

Типичный набор полей может включать ключи провайдеров, адрес локального Ollama, токен Telegram-бота и порт Gateway. Если есть поддержка нескольких провайдеров, обязательно зафиксируйте приоритет и fallback-логику, иначе агент будет обращаться не туда, куда вы ожидаете. На практике это одна из самых частых причин «почему он отвечает не той моделью».

CLI: запуск, инициализация и диагностика

Если проект предоставляет CLI, используйте его не только для старта, но и для проверки конфигурации. Обычно полезны команды вроде инициализации шаблона, вывода справки, проверки env и режима verbose. Точные команды зависят от реализации и версии, поэтому ориентируйтесь на --help и README.

npx <cli> --help

npm run dev

npm run start

npm run lint

npm run testПри отладке важно разделять ошибки на три группы: проблема кода, проблема конфигурации и проблема внешнего API. Если агент не стартует, сначала смотрите логи Gateway и сборки; если стартует, но не отвечает — проверяйте provider keys и сеть; если отвечает странно — анализируйте настройки модели, температуру и формат system prompt.

Проверка структуры проекта на GitHub

Полезно заранее изучить папки, которые могут быть важны для расширения: skills/, plugins/, mcp/, config/, examples/. Иногда именно там лежат образцы интеграций и подсказки по тому, как добавлять новые навыки. Для разработчика это экономит часы, а для пользователя — снижает риск сломать обновление при кастомизации.

| Сценарий | Когда использовать | Риск |

|---|---|---|

| GitHub source install | Нужна кастомизация и контроль | Несовместимость версий |

| Docker | Нужен быстрый старт и изоляция | Ошибки volume/env |

| VPS + systemd | Нужна постоянная работа 24/7 | Публичный доступ и безопасность |

| npm local dev | Отладка, разработка Skills | Зависимость от локальной среды |

Подключение Telegram, pairing и каналы: как сделать личного ассистента доступным в чате

Telegram — один из самых удобных каналов для личного ИИ-ассистента, потому что он уже живёт в вашем ежедневном сценарии общения. В контексте OpenClaw pairing — это сопряжение агента с Telegram-ботом, чтобы сообщения из чата попадали в Gateway и возвращались как ответы модели. Здесь особенно важны токены, правильный endpoint и понимание того, где именно агент слушает входящие сообщения.

Создание бота и первичная привязка

Сначала создайте бота через BotFather, получите токен и добавьте его в переменные окружения проекта. Затем проверьте, как именно в OpenClaw реализовано сопряжение: через polling, webhook или другой режим, описанный в документации. Если у проекта есть команда pairing, используйте её строго по инструкции и не смешивайте несколько способов одновременно.

На практике основная ошибка — подставить токен не туда или забыть перезапустить сервис после изменения .env. Ещё одна частая проблема — бот уже запущен в другом экземпляре, и Telegram не отдаёт апдейты туда, куда вы ожидаете. Если сообщения приходят с задержкой, проверьте сетевой доступ, регион VPS и тип polling/webhook.

Каналы, группы и ограничения Telegram

Если OpenClaw поддерживает каналы или маршрутизацию сообщений, настройте правила отдельно для личных чатов, групп и каналов. Для групповых сценариев полезно заранее ограничить, какие сообщения обрабатываются агентом: все, только с упоминанием, только команды или только конкретные треды. Это снижает шум и предотвращает случайные ответы на каждое сообщение.

Диагностика Telegram pairing

Если pairing не проходит, сначала убедитесь, что токен действителен и бот не заблокирован. Затем проверьте логи OpenClaw: часто там видно, получил ли Gateway запрос от Telegram и дошёл ли он до слоя обработки. Когда логов мало, включайте debug-режим и тестируйте сначала простое текстовое сообщение без вложений и кнопок.

Ollama, OpenAI API, Anthropic, Gemini и OpenRouter: выбор провайдера LLM

Выбор провайдера модели определяет и качество ответов, и стоимость владения, и приватность. Для локального сценария лучше начинать с Ollama, а для более сильных облачных моделей — подключать OpenAI API, Anthropic, Google Gemini или OpenRouter в зависимости от задач и бюджета. Актуальные цены, лимиты и поддерживаемые модели на дату публикации обязательно проверяйте в официальной документации провайдера.

Когда выбирать Ollama

Ollama — хороший вариант, если вы хотите максимально контролировать данные и запускать модели локально. Он особенно полезен для приватных задач, черновиков, классификации, кратких запросов и работы без постоянной зависимости от внешнего API. Но важно понимать ограничения железа: чем слабее CPU/GPU, тем ниже скорость и тем меньше модель вы сможете комфортно держать.

Связка OpenClaw + Ollama обычно даёт лучший старт для домашнего ассистента. Сначала вы проверяете канал, Gateway и Skills на локальной модели, а потом уже подключаете облачный провайдер как fallback или отдельный маршрут для сложных задач. Это практичнее, чем сразу строить систему вокруг дорогого API.

Когда нужны облачные провайдеры

Если вам важны качество рассуждений, мультиязычность, сложные инструкции и богатый контекст, облачные модели часто выигрывают у локальных по удобству. OpenAI API, Anthropic, Gemini и OpenRouter дают широкий выбор моделей под разные сценарии: чат, code assistant, суммаризация, extraction, tools calling. Но вместе с этим растут расходы, а данные уходят к третьей стороне, поэтому здесь особенно важны политика приватности и минимизация лишнего контента в промптах.

| Провайдер | Плюсы | Минусы | Где подходит |

|---|---|---|---|

| Ollama | Локально, приватно, без API-ключей | Ограничение по железу и скорости | Домашний сервер, офлайн-сценарии |

| OpenAI API | Качество и зрелая экосистема | Стоимость и зависимость от внешнего сервиса | Универсальные ассистенты, tools |

| Anthropic | Сильные текстовые задачи, длинный контекст | Требует учёта лимитов и бюджета | Аналитика, письма, разбор документов |

| Google Gemini | Интеграция с экосистемой Google | Надо внимательно следить за конфигурацией API | Мультимодальные сценарии |

| OpenRouter | Агрегация моделей и гибкость | Зависимость от маршрутизации и прайсинга | Эксперименты и сравнение моделей |

Как выбрать модель по задаче

Для бытового ассистента в Telegram часто достаточно локальной модели через Ollama, особенно если запросы короткие: напоминания, черновики, простые ответы, сводки. Для сложных задач — генерации текста, кода, анализа — удобнее подключить облачный провайдер как основной или резервный. Важно, чтобы OpenClaw позволял явно задавать приоритет провайдера и fallback, иначе вы потеряете контроль над стоимостью.

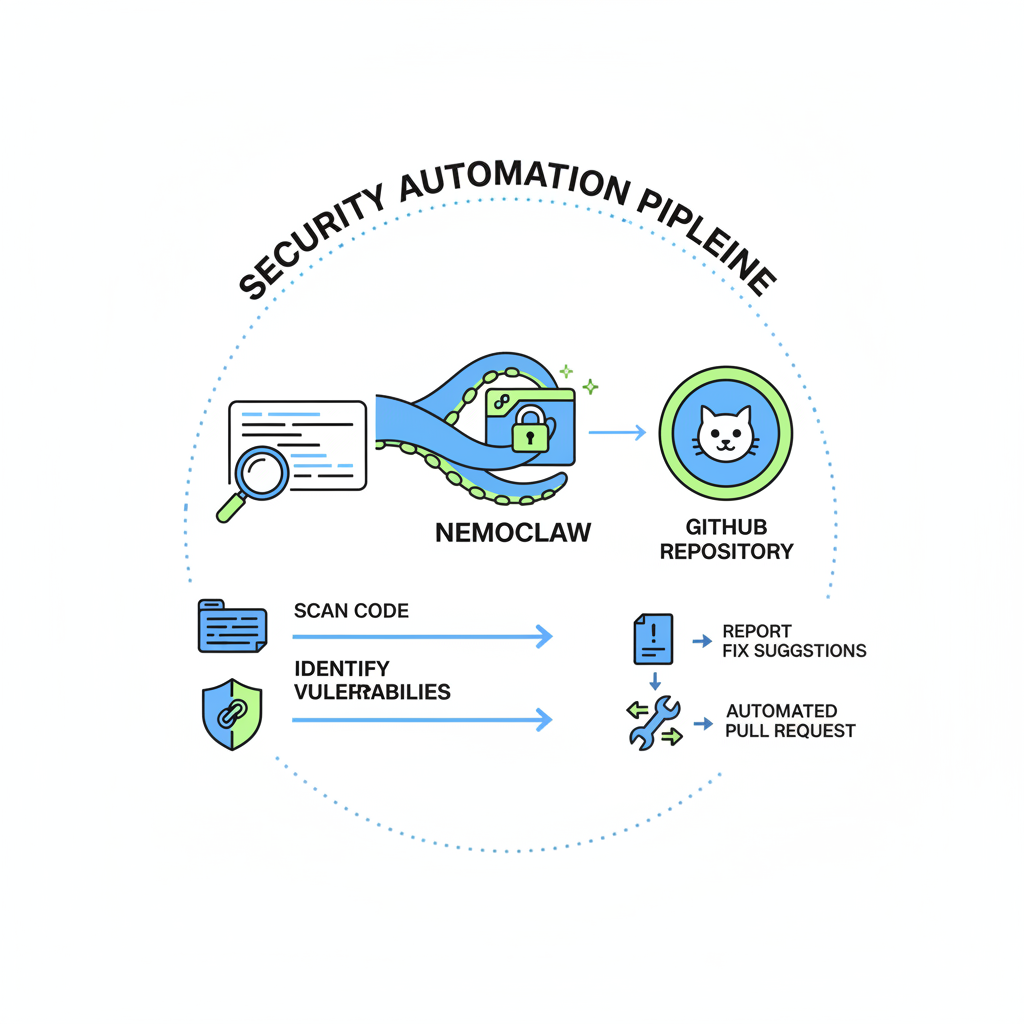

Skills, MCP и расширяемость: как превратить агента из чата в рабочий инструмент

Одна из сильных сторон self-hosted агента — возможность не ограничиваться обычным чат-ботом. Skills в OpenClaw — это, по сути, навыки или расширения, которые добавляют действия: работа с файлами, обращение к API, управление задачами, интеграция с GitHub или внутренними сервисами. MCP (Model Context Protocol) полезен там, где нужен стандартный способ подключать внешние инструменты и источники данных.

Что дают Skills на практике

Skills позволяют агенту выполнять не только генерацию текста, но и прикладные действия. Например, можно сделать навык для чтения Markdown-файлов из локального репозитория, навык для поиска по GitHub issues или навык для формирования отчёта по шаблону. Чем лучше вы структурируете такие расширения, тем легче потом переносить их между версиями.

На практике лучше начинать с малых и безопасных Skills: чтение, поиск, суммаризация, генерация черновиков. Запись в систему, выполнение shell-команд и управление внешними сервисами должны идти последними, после настройки ограничений и подтверждений. Иначе агент быстро станет удобным способом случайно навредить себе.

MCP как стандарт интеграций

Если OpenClaw поддерживает MCP, это может заметно упростить подключение внешних инструментов. Вместо набора разрозненных интеграций вы получаете более стандартный слой, который легче тестировать и повторно использовать. Однако не стоит ожидать магии: всё равно придётся описывать права доступа, форматы данных и обработку ошибок.

Для разработчика MCP полезен ещё и тем, что снижает связность между агентом и конкретным сервисом. Сегодня вы подключили GitHub, завтра — внутренний REST API или файловый индекс, и логика агента при этом остаётся примерно той же. Это особенно удобно, если вы развиваете личного ассистента поэтапно.

Как не сломать расширяемость

Самая частая ошибка — смешать в одном навыке слишком много задач. Лучше разбить функциональность на небольшие модули: один навык отвечает за чтение данных, другой — за фильтрацию, третий — за публикацию результата. Такой дизайн проще тестировать, легче документировать и безопаснее выкатывать в продакшн.

Установка через Docker и запуск на VPS: когда это лучше исходников

Docker часто оказывается самым удобным способом развернуть OpenClaw, если вы хотите быстро воспроизводимый запуск и меньше ручной возни с зависимостями. Для VPS это особенно удобно: контейнер можно перезапускать, обновлять по тегам и переносить между серверами. Но Docker не отменяет необходимость понимать, что лежит в .env, какие порты открыты и где хранятся данные.

Когда выбирать Docker

Docker хорош, если вы хотите изолировать зависимости, избежать конфликтов Node.js версий и быстрее повторить установку на другом сервере. Это также удобный путь для тестирования релизов, когда нужно сравнить несколько версий OpenClaw без загрязнения локальной системы. Однако для разработки Skills иногда удобнее нативный запуск, потому что ошибки видны раньше и проще отлаживаются в терминале.

Развёртывание на VPS

На VPS сначала создайте отдельного пользователя, закройте лишние порты и определите, нужен ли вам публичный доступ к Gateway. Если нужен только Telegram-канал, часто достаточно, чтобы агент был доступен только изнутри сервера и выходил наружу через API провайдера. Если же предполагается веб-панель или внешнее управление, обязательно добавляйте TLS, firewall и ограничение доступа.

docker compose up -d

docker compose logs -f

docker compose pull

docker compose restartПри обновлении сначала проверьте changelog и миграции конфигурации. Иногда достаточно заменить образ, а иногда нужно вручную добавить новые env-переменные или изменить структуру Skills. GitHub Releases здесь экономят время: они обычно прямо показывают, есть ли breaking changes.

Что хранить в volumes, а что в git

В git не должны попадать токены, базы данных, runtime-логи и персональные данные. В volumes или отдельном каталоге хранятся state, кэш, локальные данные Skills, если проект это предусматривает. Чем чище разделение кода и данных, тем проще резервное копирование и восстановление после сбоя.

| Ошибка | Симптом | Что делать |

|---|---|---|

| Неверный API key | 401/403 в логах | Проверить env, права и формат ключа |

| Не запущен Ollama | Connection refused | Поднять сервис и проверить endpoint |

| Конфликт порта | Address already in use | Сменить порт или остановить другой процесс |

| Telegram pairing не работает | Нет входящих сообщений | Проверить токен, polling/webhook и логи |

| Сломан .env | Приложение стартует с дефолтами | Проверить имя файла, кодировку и формат |

Безопасность, приватность и сравнение с альтернативами

Self-hosted агент даёт контроль, но не отменяет риски. Если Gateway открыт в интернет, а Telegram-бот и API-ключи лежат в слабозащищённой конфигурации, вы фактически создаёте поверхность атаки для своих секретов и данных. Поэтому OpenClaw стоит рассматривать как инженерный проект: сначала модель угроз, потом доступы, потом удобство.

Что важно с точки зрения приватности

Если вы используете локальный Ollama, данные не уходят к внешнему провайдеру, и это плюс для приватности. Но как только вы подключаете облачные API, входные данные, системные промпты и часть контекста могут обрабатываться третьей стороной, а значит, нужно минимизировать лишние сведения. Для рабочих и личных ассистентов это особенно важно: не передавайте больше, чем нужно для ответа.

Сравнение с готовыми SaaS-ассистентами

По сравнению с готовыми облачными ассистентами OpenClaw выигрывает в контроле над данными, кастомизации и расширяемости через Skills и интеграции. Однако за это приходится платить временем на установку, отладку и сопровождение. Если вам нужен мгновенный результат без DevOps-обвязки, SaaS иногда практичнее; если нужен свой стек и прозрачность, self-hosted вариант очевидно сильнее.

Базовые правила защиты

- Не открывайте Gateway в интернет без auth и TLS.

- Храните токены в переменных окружения, а не в коде.

- Используйте отдельные ключи для теста и продакшена.

- Ограничивайте права Telegram-бота и доступа к групповым чатам.

- Регулярно пересматривайте релизы и breaking changes в GitHub.

FAQ: частые вопросы про OpenClaw, GitHub и установку из исходников

Как установить OpenClaw с GitHub из исходников?

Сначала клонируйте официальный репозиторий, затем прочитайте README и файл с примером переменных окружения. Обычно дальше идут установка зависимостей, настройка .env и запуск через npm, CLI или Docker — точная схема зависит от версии проекта.

Что такое Gateway в OpenClaw?

Gateway — это точка входа для управления агентом и маршрутизации запросов к моделям, каналам и, возможно, Skills. На практике именно через Gateway удобнее всего проверять конфигурацию, логи и интеграции.

Как подключить Telegram к OpenClaw?

Создайте Telegram-бота через BotFather, добавьте токен в переменные окружения и выполните pairing по инструкции из документации. Если сообщения не приходят, проверьте polling/webhook, логи и то, не запущен ли другой экземпляр бота.

Можно ли использовать Ollama вместо облачного API?

Да, если OpenClaw поддерживает локальный endpoint Ollama или совместимый формат подключения. Это хороший выбор для приватности и экономии, но скорость и качество зависят от вашего железа и выбранной модели.

Почему OpenClaw не запускается после установки?

Чаще всего причина в неправильном .env, конфликте портов, несовместимой версии Node.js или недоступном провайдере LLM. Начните с логов, затем проверьте README, релизные заметки и доступность внешних сервисов.

Где смотреть релизы OpenClaw на GitHub?

Откройте раздел Releases в официальном репозитории и сверяйте версию с документацией и примерами конфигурации. Это особенно важно перед обновлением, потому что в релизах часто описывают изменения в Gateway, Skills и переменных окружения.

Нужен ли Docker для OpenClaw?

Не всегда, но Docker сильно упрощает повторяемый запуск на Windows, macOS, Linux и VPS. Если вы хотите быстро обновляться и изолировать зависимости, контейнеры обычно удобнее ручной сборки из исходников.

Заключение: когда выбирать GitHub-установку OpenClaw и что делать дальше

Если вам нужен личный ИИ-ассистент с контролем над данными, расширяемостью и возможностью работать как с локальными, так и с облачными моделями, то OpenClaw на GitHub — логичный старт. Установка из исходников даёт прозрачность: вы видите релизы, структуру проекта, Skills, настройки Gateway и реальные точки интеграции с Telegram и провайдерами LLM. Для большинства пользователей лучшая стратегия — начать с локального запуска, затем подключить Telegram, после этого добавить Ollama и только потом подключать облачные API.

Самый безопасный и практичный путь такой: изучите официальный репозиторий, проверьте релизы, соберите проект по инструкции, зафиксируйте конфигурацию в .env и тестируйте по одному компоненту за раз. После успешного локального прогона можно переносить OpenClaw на VPS, настраивать постоянный запуск и постепенно добавлять Skills и MCP-интеграции. Если вы хотите идти дальше, проверьте актуальную документацию OpenClaw и подпишитесь на релизы в репозитории.

Читать дальше в блоге про OpenClaw