AI Агенты -

Open Felix: локальный ИИ-агент для macOS — обзор и настройка

Open Felix — это удобный способ собрать локального ИИ-ассистента на macOS, если вам нужен контроль над данными, гибкая интеграция с Telegram, поддержка локальных и облачных LLM-провайдеров и расширяемость через Skills и MCP. На практике такой агент особенно полезен разработчикам,

Open Felix — это удобный способ собрать локального ИИ-ассистента на macOS, если вам нужен контроль над данными, гибкая интеграция с Telegram, поддержка локальных и облачных LLM-провайдеров и расширяемость через Skills и MCP. На практике такой агент особенно полезен разработчикам, которые хотят запускать ИИ на своём Mac, подключать Ollama, OpenAI API, Anthropic, Google Gemini или OpenRouter и управлять всем через Gateway (точку входа для управления агентом).

Если вы рассматриваете Open Felix как часть экосистемы OpenClaw, начинайте с официальной документации и README в репозитории: актуальные команды установки, названия переменных окружения и поддерживаемые интеграции могут меняться. Ниже я покажу типовой путь для macOS, разберу настройку через CLI, Docker и переменные окружения, объясню pairing (сопряжение с Telegram), а также перечислю типичные ошибки, которые чаще всего всплывают на практике.

Что такое Open Felix и кому он подходит

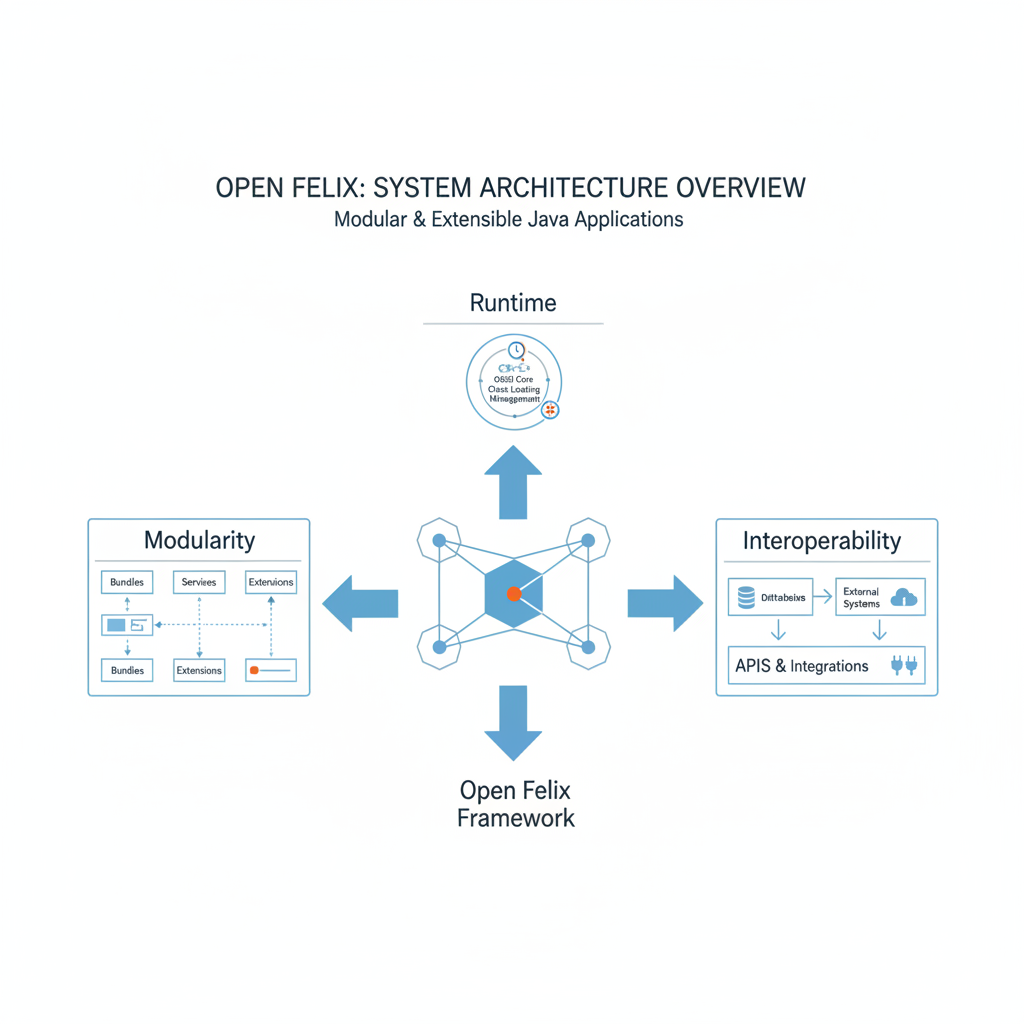

Open Felix удобно воспринимать как личного ИИ-агента, который живёт рядом с вами: на Mac, в Docker-контейнере, на VPS или в связке с Telegram. Если говорить языком архитектуры, Gateway — это точка входа для управления агентом, а Skills — подключаемые действия и сценарии, которые расширяют его возможности без переписывания всей логики. Такой подход полезен, когда нужно не просто “чатиться с моделью”, а строить рабочий инструмент: отвечать в Telegram, работать с файлами, запускать команды, ходить в MCP-сервисы и использовать разные модели под разные задачи.

Где Open Felix действительно полезен

Локальный ИИ-ассистент особенно хорош, если у вас есть требования к приватности, вы часто работаете офлайн или хотите снизить стоимость запросов, используя Ollama на собственном железе. Для прототипирования Open Felix удобен тем, что можно быстро переключать провайдеров: локальную модель для черновиков, облачную — для сложных задач, где важнее качество рассуждений. На практике такой гибридный сценарий часто оказывается разумнее, чем полная зависимость от одного API.

Что важно понимать заранее

OpenClaw и связанные с ним компоненты — это не “магия из коробки”, а инженерная сборка из нескольких частей: агент, провайдеры LLM, каналы общения, Skills, возможно MCP и окружение запуска. Это значит, что при установке вы почти наверняка столкнётесь с переменными окружения, токенами, путями к файлам и сетевыми ограничениями macOS. Если Gateway открыт наружу без ограничений, а секреты лежат в незашифрованных конфигурациях, риски становятся вполне реальными.

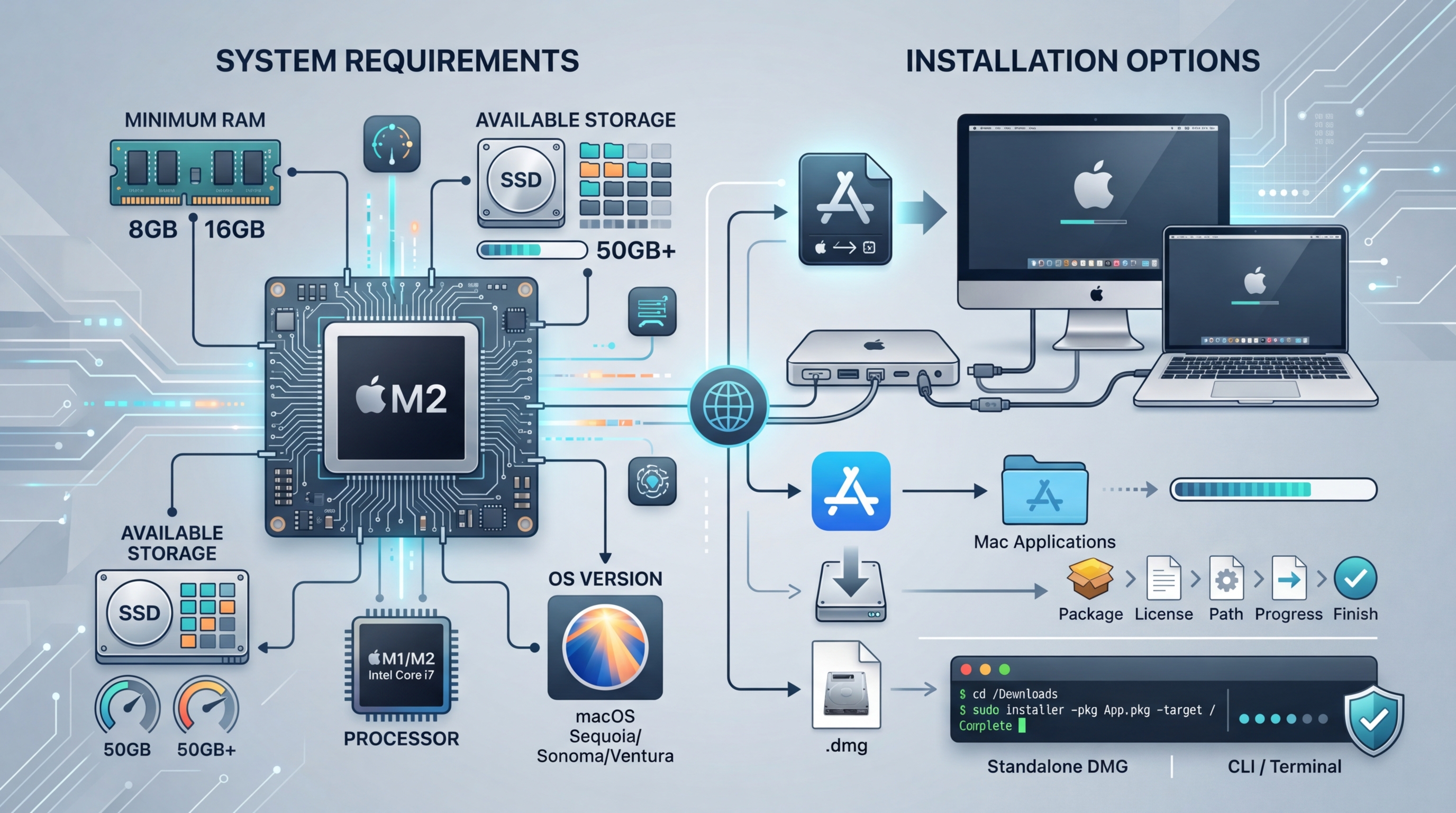

Системные требования и варианты установки на macOS

На macOS удобнее всего начинать с CLI-установки или Docker-варианта, если проект это поддерживает в текущей версии документации. В экосистеме Node.js обычно нужны актуальный npm, Node.js LTS и корректно настроенные права доступа к файлам и сети; для Docker — установленный Docker Desktop или совместимый runtime. Если агент работает локально через Ollama, заранее убедитесь, что модель скачана и доступна на вашем Mac, иначе первый запуск будет “падать” в ожидании модели или завершаться ошибкой подключения.

Базовый чек-лист перед установкой

Для комфортного старта на macOS проверьте, что у вас есть не менее 16 ГБ ОЗУ, свободное место под модели и контейнеры, а также актуальная версия macOS. Если планируете использовать локальные модели, M-серия процессоров заметно упрощает жизнь: inference обычно стабильнее, чем на старых Intel-машинах, особенно при больших контекстах. Для облачных провайдеров требования скромнее, но стабильный интернет и правильные лимиты API становятся критичными.

| Вариант | Плюсы | Минусы | Когда выбирать |

|---|---|---|---|

| CLI / npm | Быстрый старт, проще отладка | Нужно следить за Node.js и зависимостями | Локальная разработка и тестирование |

| Docker | Изоляция, повторяемость | Чуть сложнее доступ к локальным ресурсам | Стабильный деплой и переносимость |

| Ollama локально + агент | Приватность, контроль расходов | Требует ресурсов машины | Локальные ассистенты и офлайн-сценарии |

Типовой порядок установки

Точный путь зависит от текущего релиза OpenClaw/Open Felix, но обычно последовательность выглядит одинаково: установить зависимости, задать переменные окружения, запустить Gateway и подключить канал, например Telegram. Если проект публикуется через GitHub и npm, проверьте версию пакета и release notes, чтобы не использовать устаревшие флаги. На практике самый частый источник ошибок — несовпадение названий переменных окружения между README и старой статьёй из блога.

- Установите Node.js LTS и npm или используйте рекомендованную версию из документации.

- Склонируйте репозиторий с GitHub или установите пакет через npm, если так указано в README.

- Создайте файл

.envи внесите ключи провайдеров, токен Telegram и параметры Gateway. - Запустите агент локально или в Docker и проверьте логи на старте.

- Подключите Ollama или облачный API и протестируйте короткий запрос.

Gateway, CLI и переменные окружения: как собрать основу агента

Gateway — центральная точка входа, через которую вы управляете агентом, а CLI помогает запускать, проверять и дебажить сервисы без лишней оболочки. Если приложение использует JSON/YAML-конфиг и .env, не смешивайте уровни ответственности: секреты держите в переменных окружения, а не в репозитории. Для self-hosted ИИ-агента это особенно важно, потому что один неверный коммит может раскрыть токены Telegram, OpenRouter или облачных моделей.

Что обычно настраивается через .env

В типичной схеме указывают URL для локального провайдера, ключ API, режим логирования, порт Gateway, адрес Telegram-бота и флаги для Skills. Названия переменных зависят от проекта, поэтому ниже я привожу не “канонический” список, а рабочую логику, которую надо сверить с официальной документацией. Если в README упоминается отдельный файл конфигурации, лучше следовать ему буквально, а .env оставить только для секретов и переопределений.

PORTили аналог — порт, на котором слушает Gateway.LLM_PROVIDER— выбранный провайдер: Ollama, OpenAI, Anthropic, Gemini, OpenRouter и т. д.API_KEYили провайдер-специфичный ключ.TELEGRAM_BOT_TOKEN— токен бота для Telegram-интеграции.MCP_*— параметры подключения к MCP-сервисам, если они используются.

Минимальная схема запуска

Если проект работает через npm, типовой старт выглядит как установка зависимостей и запуск dev или start-скрипта, например через npm install и npm run start, но конкретные команды надо брать из README. Для Docker чаще используются docker build, docker run или docker compose up -d, если в репозитории есть compose-файл. При отладке всегда смотрите логи в реальном времени: многие ошибки провайдера проявляются только после первого запроса к модели.

| Параметр | Что проверять | Частая ошибка |

|---|---|---|

| Порт Gateway | Свободен ли порт на Mac | Конфликт с другим сервисом |

| API-ключ | Ключ активен и без ограничений | 401 Unauthorized |

| URL провайдера | Правильный endpoint | Ошибочный base URL или протокол |

| Telegram token | Токен взят у BotFather | Бот не отвечает из-за неверного токена |

Telegram, pairing и каналы взаимодействия

Telegram часто становится самым удобным каналом для личного ассистента: вы пишете сообщение, а агент отвечает, запускает действия и при необходимости обращается к Skills. Pairing — это сопряжение с Telegram, когда вы связываете бота, Gateway и вашу учётную запись или чат по правилам проекта. Если документация OpenClaw поддерживает несколько каналов, Telegram обычно один из самых практичных, потому что он уже есть на телефоне и хорошо работает как мобильный интерфейс к агенту.

Как обычно подключают Telegram

Сначала создают бота через BotFather, получают токен и добавляют его в переменные окружения. Затем настраивают разрешённые чаты, если проект умеет ограничивать доступ, и запускают Gateway с включённым Telegram-плагином или модулем канала. После этого отправляют тестовое сообщение и смотрят, как агент отвечает: сразу, через callback или с промежуточной валидацией действий.

Безопасность Telegram-интеграции

Самая частая ошибка — считать Telegram “просто чатом” и не ограничивать круг пользователей. На практике Telegram-бот, подключённый к агенту с доступом к командам и Skills, может стать прямым входом в ваши локальные данные или облачные расходы. Поэтому полезно заранее настроить whitelist чатов, ограничение по user ID, журналирование и запрет опасных команд, если проект это поддерживает.

Практический сценарий использования

Хороший бытовой сценарий — отправлять в Telegram короткие задания: “собери заметку”, “найди в репозитории файл”, “создай черновик письма”, “объясни лог ошибки”. Если агент умеет работать с контекстом и подключён к правильному провайдеру, он быстро становится личным командным интерфейсом. Для macOS это особенно удобно, когда вы не хотите постоянно держать окно терминала открытым.

Провайдеры LLM: Ollama, OpenAI, Anthropic, Gemini и OpenRouter

Сильная сторона Open Felix и всей экосистемы OpenClaw — возможность подключать разные LLM-провайдеры под разные задачи. Локальный Ollama даёт приватность и предсказуемую стоимость, а облачные API вроде OpenAI API, Anthropic, Google Gemini и OpenRouter часто лучше справляются со сложными рассуждениями, длинным контекстом и задачами классификации. Цены и условия у всех провайдеров меняются, поэтому всегда проверяйте актуальность на дату публикации и официальную документацию.

Когда выбирать локальную модель через Ollama

Ollama хороша, когда вы хотите держать данные на своём Mac, не зависеть от лимитов облака и спокойно экспериментировать. Для черновиков, локальных заметок, поиска по файлам и бытовых команд этого часто достаточно. Важно только помнить, что качество сильно зависит от конкретной модели, объёма памяти и того, насколько хорошо вы настроили контекст и системные инструкции.

Когда имеет смысл облачный провайдер

OpenAI, Anthropic, Gemini и OpenRouter удобны, если нужен более сильный reasoning, стабильный формат ответов или поддержка специфических моделей. В production-сценариях часто делают гибридную схему: локальная модель отвечает за рутину, а облачная подключается только когда задача сложнее или требуется высокая точность. Это помогает оптимизировать расходы и снизить зависимость от одного поставщика.

Сравнение провайдеров

| Провайдер | Сильные стороны | Ограничения | Лучший сценарий |

|---|---|---|---|

| Ollama | Локальность, приватность, контроль | Нужны ресурсы Mac, качество зависит от модели | Личный ассистент и офлайн-режим |

| OpenAI API | Сильные модели, зрелая экосистема | Зависимость от ключей и тарификации | Сложные запросы и универсальные задачи |

| Anthropic | Сильная работа с длинным контекстом | Требует сверки лимитов и цен | Аналитика, текст, аккуратные ответы |

| Google Gemini | Интеграции и конкурентные модели | Нужно следить за региональными ограничениями | Смешанные задачи и быстрые эксперименты |

| OpenRouter | Единая точка доступа к множеству моделей | Дополнительный посредник в цепочке | Сравнение моделей и гибкая маршрутизация |

Skills, MCP и расширяемость личного ИИ-агента

Если вам нужен не просто чат-бот, а рабочий агент, Skills и MCP становятся ключевыми элементами. Skills — это прикладные сценарии и действия, которые агент может выполнять; MCP (Model Context Protocol) — способ подключать внешние инструменты и сервисы по стандартному интерфейсу, если проект это поддерживает. В реальной эксплуатации именно расширяемость превращает Open Felix из “демо” в полезный инструмент на каждый день.

Какие Skills обычно подключают

На практике чаще всего нужны навыки для работы с файлами, git-операциями, резюмированием документов, поиском по заметкам, генерацией черновиков и автоматизацией рутинных команд. Для Mac особенно полезны Skills, которые умеют безопасно работать с локальной файловой системой и запускать только разрешённые действия. Если проект поддерживает white-list команд, это нужно включать сразу, а не “после того как всё заработает”.

Когда нужен MCP

MCP помогает подключать внешние сервисы более стандартизированно, чем набор разрозненных интеграций. Это удобно, когда вы строите экосистему вокруг Notion, GitHub, внутренних API, файловых хранилищ или корпоративных инструментов. Однако каждая новая интеграция увеличивает поверхность атаки, поэтому доступы и токены нужно выдавать минимально необходимыми.

Практика внедрения расширений

Лучший подход — сначала поднять базового агента, потом добавить один Skill, затем один MCP-источник и только после этого строить сложные цепочки. Если подключать всё сразу, вы не поймёте, где именно возникла ошибка: в модели, в токене, в adapter-слое или в логике самого действия. Такой поэтапный запуск экономит часы отладки и снижает риск сломать рабочую конфигурацию.

Безопасность, приватность и эксплуатация на macOS, Docker и VPS

Безопасность в личных ИИ-агентах — это не дополнительный пункт, а часть архитектуры. Если вы запускаете Open Felix на macOS, в Docker или на VPS, вам нужно заранее решить, где хранятся секреты, кто имеет доступ к Gateway и как ограничены команды, которые агент может выполнять. На практике многие проблемы начинаются не с LLM, а с того, что кто-то оставил открытый порт, залил .env в GitHub или дал боту доступ к публичному чату без ограничений.

macOS: локальность не отменяет риск

Даже локальный агент может стать проблемой, если на машине работает несколько пользователей, включён проброс портов или используются общие папки. На Mac особенно полезно проверять правила firewall, права приложений, доступ к Microphone/Files и способ хранения конфигураций. Если вы используете Keychain или менеджер секретов, это лучше, чем plain-text .env, хотя и требует дисциплины в деплое.

Docker и VPS: дополнительные меры

Docker даёт изоляцию, но не делает сервис автоматически безопасным: контейнер всё ещё может слушать порт наружу, а переменные окружения — утечь в логи или compose-файлы. На VPS обязательно используйте закрытый доступ, reverse proxy с TLS, ограничение по IP, а при необходимости — VPN. Если Gateway должен быть доступен из интернета, делайте это осознанно и только после проверки авторизации, логирования и обновления зависимостей.

Что делать с логами и диагностикой

Логи полезны, пока в них не начинают попадать токены, пользовательские данные и ответы моделей с чувствительной информацией. Настройте уровень логирования так, чтобы он помогал отлаживать запросы, но не раскрывал секреты. Если проект поддерживает masking, redaction или separate debug mode, это стоит включить сразу.

| Риск | Как проявляется | Что делать |

|---|---|---|

| Утечка токена | 401, несанкционированный доступ, billing spikes | Ротация ключей, .env вне Git, секреты в vault |

| Открытый Gateway | Доступ к агенту извне | Firewall, auth, VPN, bind на localhost |

| Неверный provider URL | Connection refused, timeout | Проверить base URL и порт |

| Сломанный pairing | Telegram молчит или отвечает не в тот чат | Проверить токен, chat ID, whitelist |

Типичные ошибки, отладка и сравнение с альтернативами

В реальном внедрении Open Felix почти всегда упирается в одни и те же вещи: неверные переменные окружения, конфликт портов, проблемы с сетью, устаревшие зависимости и неправильная конфигурация провайдера. Хорошая новость в том, что большинство проблем диагностируется по логам и короткому списку проверок. Если вы уже работали с self-hosted агентами, то заметите, что паттерн ошибок у OpenClaw очень похож на другие Node/Docker-проекты: сначала ломается инфраструктура, а уже потом — “умные” части.

Частые ошибки при запуске

Самые распространённые сценарии — 401 Unauthorized из-за плохого ключа, 404 из-за неправильного endpoint, ECONNREFUSED из-за не запущенного Ollama или закрытого порта, и пустые ответы Telegram-бота из-за неправильно настроенного webhook или polling. Если агент работает через CLI, обязательно проверяйте, какой файл конфигурации реально загружается, а не тот, который вы редактировали “на глаз”.

Пошаговая диагностика

Начинайте с самого нижнего уровня: сеть, порт, переменные окружения, потом провайдер, потом канал Telegram, потом Skills и MCP. Это особенно важно, когда в конфиге много слоёв и кажется, что “всё настроено правильно”. Практика показывает, что 80% проблем решаются простыми действиями: проверить printenv, посмотреть логи, повторно пройти pairing и сделать тестовый запрос через минимальный prompt.

- Проверьте, что процесс Gateway запущен и слушает нужный порт.

- Убедитесь, что выбранный provider отвечает напрямую, без агента.

- Проверьте переменные окружения и отсутствие опечаток.

- Протестируйте Telegram отдельно от Skills и MCP.

- Только потом включайте расширения и автоматизацию.

Open Felix и альтернативы

Если сравнивать с “чистыми” чат-клиентами, Open Felix выигрывает за счёт self-hosted модели и гибкой архитектуры, но требует больше настройки. По сравнению с полностью облачными решениями он даёт больше контроля и приватности, однако вы сами отвечаете за доступность, обновления и безопасность. В этом смысле OpenClaw и Open Felix больше похожи на инженерную платформу, чем на готовый массовый SaaS-продукт.

Часто задаваемые вопросы

Ниже собрал вопросы, которые реально возникают у людей, настраивающих Open Felix и другие self-hosted агенты. Ответы короткие, но с практическим акцентом: что проверить, с чего начать и где чаще всего бывает ошибка. Если какой-то параметр не совпадает с вашей версией проекта, ориентируйтесь на официальный README и релизы.

Как установить Open Felix на macOS?

Обычно нужен Node.js LTS, npm или Docker и актуальная инструкция из GitHub-репозитория. Сначала поднимают базовый запуск без Telegram и без MCP, затем добавляют провайдер LLM и только потом подключают каналы и Skills.

Как подключить Telegram к Open Felix?

Нужно создать бота через BotFather, получить токен и добавить его в переменные окружения, после чего включить Telegram-канал в конфигурации проекта. Для первого теста используйте отдельный чат и проверьте, что pairing настроен корректно и бот отвечает именно туда, куда нужно.

Можно ли использовать Ollama с Open Felix локально?

Да, это один из самых удобных сценариев для macOS, если вам важны приватность и контроль расходов. Убедитесь, что Ollama запущена, модель скачана, а URL провайдера и порт прописаны без ошибок в конфигурации.

Что такое Gateway в OpenClaw?

Gateway — это точка входа для управления агентом: через него обычно проходит конфигурация, маршрутизация запросов и подключение каналов. Если Gateway открыт наружу без ограничений, это создаёт риск несанкционированного доступа, поэтому его нужно защищать как минимум firewall’ом и авторизацией.

Как добавить Skills в Open Felix?

Способ зависит от версии проекта, поэтому смотрите официальную документацию по Skills и структуре конфигурации. На практике лучше начинать с одного безопасного навыка — например, чтения файлов или генерации заметок — и не открывать агенту лишние системные полномочия.

Почему Open Felix не отвечает в Telegram?

Чаще всего проблема в токене бота, chat ID, webhook/polling или в том, что Gateway не поднят. Проверьте логи, убедитесь, что сам провайдер LLM работает, и только потом ищите ошибку в Telegram-подключении.

Что лучше: локальная модель или облачный API?

Если приоритет — приватность и контроль, начинайте с Ollama. Если важнее качество ответа и сложные задачи, подключайте OpenAI API, Anthropic, Google Gemini или OpenRouter, но обязательно проверяйте актуальные цены и лимиты на дату публикации.

Заключение

Open Felix на macOS — это хороший выбор, если вам нужен не абстрактный чат с моделью, а управляемый личный ИИ-агент с Gateway, Telegram, провайдерами LLM, Skills и, при необходимости, MCP. В реальной работе лучше всего себя показывает поэтапный запуск: сначала базовая сборка, потом локальная модель или облачный API, затем каналы, расширения и только после этого автоматизация. Такой подход экономит время, снижает риск утечки секретов и помогает действительно понять архитектуру, а не просто “заставить что-то ответить”.

Если вы планируете развивать проект дальше, проверьте актуальную документацию OpenClaw и подпишитесь на релизы в репозитории, чтобы не пропустить изменения в CLI, переменных окружения и поддержке провайдеров. Для дополнительного чтения можете открыть Читать дальше в блоге про OpenClaw и сверить свои настройки с официальным README проекта.