AI Агенты -

Open Felix: локальный ИИ-агент для macOS — обзор и настройка

Open Felix MacOS — это удобный сценарий развертывания локального ИИ-агента на macOS, если вы хотите запускать ассистента на своём ноутбуке, подключать Telegram, использовать локальные и облачные LLM-провайдеры и управлять всем через Gateway (точку входа для управления агентом). Н

Open Felix MacOS — это удобный сценарий развертывания локального ИИ-агента на macOS, если вы хотите запускать ассистента на своём ноутбуке, подключать Telegram, использовать локальные и облачные LLM-провайдеры и управлять всем через Gateway (точку входа для управления агентом). На практике OpenClaw хорошо подходит тем, кто хочет собрать личного ИИ-ассистента без лишней зависимости от облака: часть задач отдавать Ollama, часть — OpenAI API, Anthropic, Google Gemini или OpenRouter, а интеграции и автоматизацию расширять через Skills и MCP.

Ниже я разберу, как обычно ставят и отлаживают такой стек на macOS: от системных требований и установки через GitHub/npm/Docker до pairing (сопряжения с Telegram), настройки переменных окружения, выбора провайдера модели, типичных ошибок и соображений по безопасности. Версии ПО и цены API актуально проверять на дату публикации в официальной документации OpenClaw, Ollama, OpenAI, Anthropic, Google и OpenRouter.

Что такое OpenClaw и зачем он нужен на macOS

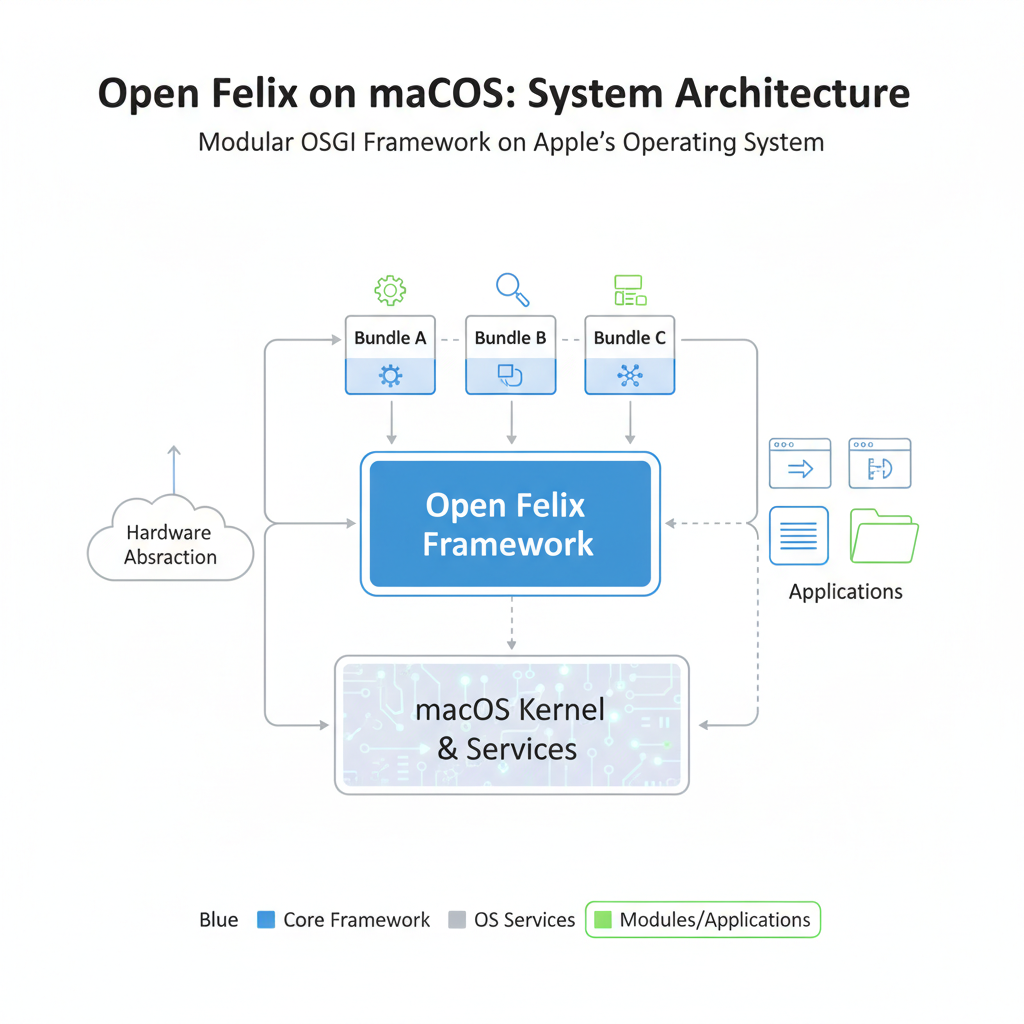

OpenClaw — это платформа для self-hosted ИИ-агентов, где вы сами контролируете запуск, доступы, каналы связи и источники LLM. Для macOS это особенно удобно: у многих разработчиков MacBook уже есть как рабочая машина, а значит можно поднять личного ассистента локально, без отдельного сервера. В этой модели агент может выполнять роль помощника в терминале, маршрутизатора запросов к моделям и интеграционного слоя между Telegram, MCP-сервисами и локальными инструментами.

Для кого подходит локальный ИИ-агент на Mac

Если вы разработчик, DevOps-инженер, аналитик или техлид, OpenClaw на macOS полезен, когда нужен приватный ассистент для заметок, команд, поиска по контексту, простых автоматизаций и общения через Telegram. Для личного пользования это ещё и способ тестировать ИИ-воркфлоу без постоянной оплаты за каждое обращение к облачному API. Для командной работы Mac может выступать как компактная рабочая станция для прототипирования и демонстрации сценариев.

На практике чаще всего начинают с одной цели: «хочу писать боту в Telegram, а ответы получать от локальной модели или облачного провайдера по выбору». Далее добавляют Skills — специальные расширения логики, через которые агент может выполнять прикладные действия. Если рядом есть MCP-серверы или собственные внутренние инструменты, OpenClaw становится оркестратором, а не просто чат-обёрткой.

Ключевые сущности: Gateway, Skills, providers, CLI

Gateway — это точка входа для управления агентом: через него обычно проходят команды, управление соединениями, маршрутизация запросов и интеграции. Providers — это провайдеры LLM, то есть источники моделей: Ollama, OpenAI, Anthropic, Gemini, OpenRouter и другие совместимые API. CLI — командная строка, через которую часто выполняют установку, запуск, проверку статуса и диагностику.

Skills — расширяемые сценарии или «умения» агента: от работы с файлами и вебхуками до вызова внешних сервисов. Именно Skills обычно превращают абстрактного чат-бота в полезный инструмент. В документации OpenClaw структура и набор возможностей могут меняться, поэтому стоит сверяться с README и официальными разделами репозитория.

Подготовка macOS: системные требования, инструменты и чек-лист

OpenClaw на macOS обычно проще всего запускать в окружении, где уже есть Homebrew, актуальный Node.js и, при необходимости, Docker. Для локальных моделей нужен либо Ollama, либо совместимый локальный сервер, а для Telegram — стабильный доступ в интернет и корректно заданные токены. На Apple Silicon и Intel шаги в целом похожи, но у некоторых компонентов будут различаться пакеты и производительность.

Минимальный набор перед установкой

В типичном сценарии вам понадобятся: macOS с актуальными обновлениями, Homebrew, Node.js LTS, npm, Git, Docker Desktop или альтернативный Docker runtime, а также Ollama, если планируете локальные модели. Если агент будет работать через Telegram, нужен бот-токен от BotFather. Если вы хотите использовать облачные модели, заранее заведите ключи API и проверьте лимиты/тарифы у провайдера.

Частая ошибка новичков — начинать установку без понимания, где будет храниться конфигурация и секреты. Лучше сразу выделить отдельную папку для проекта, отдельный `.env` для ключей и отдельный профиль для Docker, если он используется. Это упрощает отладку и снижает риск случайно отправить токен в GitHub.

Чек-лист перед стартом

| Параметр | Рекомендация |

|---|---|

| macOS | Актуальная версия macOS, совместимая с Node.js и Docker |

| Node.js | LTS-ветка, версия актуальна на дату публикации, проверьте в документации |

| Git | Для клонирования репозитория с GitHub |

| Docker | Нужен, если вы запускаете OpenClaw в контейнере или поднимаете зависимые сервисы |

| Ollama | Для локальных моделей и приватных сценариев |

| Telegram Bot Token | Если нужен Telegram-канал и pairing |

Базовые команды установки окружения

Ниже — типичный набор команд для подготовки среды. Они не привязаны к конкретной реализации OpenClaw, но отражают практический минимум для macOS-проектов с Node.js и Docker:

brew update

brew install git node docker

node -v

npm -v

git --versionЕсли Docker Desktop вам не подходит, можно использовать альтернативные runtime-решения, но для большинства сценариев именно Docker ускоряет запуск зависимостей и повторяемость окружения. Важно помнить, что сама структура запуска OpenClaw может отличаться в зависимости от версии проекта, поэтому далее сверяйтесь с репозиторием и README.

Установка OpenClaw на macOS: локально, через Docker и через CLI

OpenClaw обычно ставят одним из трёх способов: из исходников/репозитория, через npm-пакет или в Docker-контейнере. На macOS самый комфортный путь зависит от того, что для вас важнее — удобство отладки, повторяемость или изоляция. Если вы только тестируете агент, начинайте с локального запуска; если нужен стабильный сервис, Docker часто выигрывает по воспроизводимости.

Вариант 1: установка из GitHub

Если проект распространяется через GitHub, типичный поток такой: клонировать репозиторий, установить зависимости, настроить `.env` и запустить dev/production команду, указанную в README. В реальных проектах это может выглядеть примерно так:

git clone https://github.com/<org>/openclaw.git

cd openclaw

npm install

cp .env.example .env

npm run devОднако не стоит копировать команды «вслепую»: структура может отличаться в зависимости от ветки, версии или модулей. На практике я всегда открываю README, а затем проверяю `package.json`, чтобы увидеть доступные скрипты — `dev`, `start`, `build`, `lint`, `test`. Это экономит время и снижает число ошибок вида «command not found» или «missing script».

Вариант 2: установка через npm

Если OpenClaw публикуется как npm-пакет или предоставляет CLI, удобен путь с глобальной или локальной установкой. Такой сценарий полезен, когда вы хотите запускать CLI-команды для инициализации проекта, подключения провайдера или выполнения диагностики. Примерный шаблон выглядит так:

npm install -g <package-name>

<cli-command> --helpПреимущество CLI — быстрый доступ к базовым операциям, особенно если документация хорошо описывает команды. Недостаток — некоторые функции могут быть спрятаны за флагами или требовать уже подготовленного `.env`. Поэтому не начинайте с «боевого» запуска, пока не убедились, что CLI видит нужные переменные и зависимости.

Вариант 3: Docker для изолированного запуска

Docker особенно полезен, когда у вас несколько сервисов: сам OpenClaw, отдельный провайдер локальной модели, вспомогательный Redis/PostgreSQL или MCP-компоненты. Контейнеризация делает конфигурацию воспроизводимой, а откат — простым. Для macOS это часто самый предсказуемый способ избежать конфликтов версий Node.js и системных библиотек.

Типовой подход здесь такой: собрать образ или использовать официальный, задать переменные окружения через `.env`, пробросить тома для данных и запустить контейнер через `docker compose up -d`. Если в проекте есть compose-файл, это почти всегда предпочтительнее ручного старта контейнеров. Но снова: проверяйте официальный README и примеры из репозитория, потому что названия сервисов и портов зависят от конкретной версии.

| Способ | Плюсы | Минусы |

|---|---|---|

| GitHub / локальный запуск | Простая отладка, доступ к исходникам | Зависимости и версии могут конфликтовать |

| npm / CLI | Быстрый старт и удобные команды | Зависит от качества CLI и документации |

| Docker | Повторяемость, изоляция, удобство на VPS | Нужна настройка сети и томов |

Настройка Gateway, провайдеров и переменных окружения

Большая часть проблем в self-hosted ИИ-агентах связана не с самой моделью, а с конфигурацией: неправильный URL, отсутствующий токен, конфликт портов или не тот формат переменной окружения. В OpenClaw критично правильно собрать связку Gateway + provider + секреты. Если эта тройка работает, остальное обычно настраивается уже проще.

Что обычно хранится в .env

В `.env` обычно попадают ключи API, адреса локальных сервисов, токены Telegram и параметры режима работы. Часто это выглядит как набор переменных наподобие `OPENAI_API_KEY`, `ANTHROPIC_API_KEY`, `GEMINI_API_KEY`, `OPENROUTER_API_KEY`, `OLLAMA_BASE_URL`, `TELEGRAM_BOT_TOKEN`, `GATEWAY_PORT` или аналогичных. Но конкретные названия нужно сверять с документацией проекта: OpenClaw может использовать свои префиксы или ожидаемые ключи.

Хранить секреты в репозитории нельзя. Обычно `.env` добавляют в `.gitignore`, а пример конфигурации кладут в `.env.example`. Это базовая гигиена, но именно её чаще всего игнорируют в первых тестах. Для macOS это особенно важно, если вы активно синхронизируете папки через облако или подключаете внешние резервные копии.

Выбор провайдера LLM: локально или облако

Если вам важна приватность и экономия на токенах, начинайте с Ollama. Если нужен максимум качества в сложных диалогах, берите облачные провайдеры: OpenAI API, Anthropic, Google Gemini или маршрутизацию через OpenRouter. OpenClaw обычно ценен именно тем, что позволяет переключаться между ними, не переписывая весь стек.

На практике схема часто такая: локальная модель отвечает за быстрые черновики, классификацию и простые команды, а облачный провайдер подключается для сложных задач, длинного контекста или генерации кода. Такой гибридный подход лучше контролирует бюджет и делает систему устойчивее к перебоям. Если Ollama на MacBook не справляется с нагрузкой, вы всегда можете временно переключить provider на облако.

Сравнение популярных провайдеров

| Провайдер | Когда использовать | Особенности |

|---|---|---|

| Ollama | Локальный режим, приватность, офлайн-сценарии | Зависит от железа и выбранной модели |

| OpenAI API | Качество, широкий набор моделей, стабильный API | Нужны токены и контроль затрат; цены актуальны на дату публикации |

| Anthropic | Сильные тексты, длинный контекст, аккуратные ответы | Проверьте требования к ключам и биллингу |

| Google Gemini | Экосистема Google, мультимодальные сценарии | Следите за форматом API и квотами |

| OpenRouter | Единая точка доступа к разным моделям | Удобно для тестов, но важно понимать маршрутирование и стоимость |

Telegram, pairing и каналы: как подключить личного ассистента к чату

Telegram — один из самых удобных способов общения с личным ИИ-агентом, потому что вам не нужен отдельный веб-интерфейс, достаточно привычного чата. Pairing (сопряжение с Telegram) обычно означает связывание вашего бота или аккаунта с экземпляром агента через токен, идентификатор и разрешённые каналы. Для Mac это особенно удобно: агент может работать локально, а вы писать ему с телефона.

Как обычно выглядит схема подключения

Типовой процесс начинается с создания бота через BotFather, получения токена и указания его в `.env`. Затем в конфигурации OpenClaw включается Telegram-интеграция, после чего выполняется pairing — либо через специальную CLI-команду, либо через веб/графический интерфейс, если он предусмотрен проектом. В некоторых реализациях нужен ещё список разрешённых пользователей или чат-ID.

Здесь важно не путать бот-токен и Telegram ID. Токен даёт доступ боту к API, а ID позволяет ограничить, кто вообще может взаимодействовать с вашим агентом. Для личного ассистента это крайне полезно: вы не хотите, чтобы кто угодно из интернета писал вашему локальному AI на MacBook.

Безопасная настройка Telegram-канала

Если OpenClaw поддерживает каналы или несколько точек входа, разумно сначала ограничить Telegram только одним личным чатом. Канал или группа удобны для командной работы, но они повышают риски утечки данных и случайного запуска Skills. Для персонального сценария лучше начать с приватного бота и белого списка пользователей.

Практика показывает, что ошибки здесь чаще связаны с правами бота, а не с самим агентом: бот не добавлен в чат, не разрешены сообщения, неверный токен или не заполнен endpoint для webhook/polling. Если Telegram не отвечает, проверяйте логи на стороне OpenClaw и отдельно смотрите ответы Telegram API. Это быстрее, чем пересобирать весь проект.

Типовые команды и проверки

- Создайте бота в BotFather и сохраните токен.

- Добавьте токен в `.env` или secure storage.

- Включите Telegram-интеграцию в настройках OpenClaw.

- Выполните pairing согласно README или CLI.

- Отправьте тестовое сообщение и проверьте логи Gateway.

Ollama и облачные модели: как собрать гибридный стек

Гибридный стек — это, пожалуй, самый практичный способ использовать OpenClaw на macOS. Локальные модели через Ollama дают приватность и отсутствие сетевой зависимости, а облачные провайдеры закрывают более сложные запросы. В результате вы можете не выбирать между «дёшево, но слабее» и «сильно, но дорого», а распределять задачи по классам.

Когда достаточно Ollama

Ollama хорошо подходит для быстрых рутинных операций: краткое суммирование текста, простые классификации, черновые ответы, локальные утилиты и тестирование интеграций. На Mac с Apple Silicon производительность часто заметно лучше, чем на старом Intel, но всё равно нужно учитывать размер модели, квантование и доступную память. Если у вас много параллельных задач, локальная модель может стать узким местом.

На практике я советую начать с небольшой модели и постепенно увеличивать её размер, чтобы понять пределы железа. Это помогает избежать ситуации, когда агент «тормозит» не из-за OpenClaw, а из-за слишком тяжёлой модели в Ollama. Для диагностики полезно отдельно проверить, что Ollama отвечает напрямую, без OpenClaw.

Когда лучше облачный provider

Облачный provider обычно выигрывает в сложных многошаговых рассуждениях, генерации кода, длинных контекстах и работе с нестандартными форматами. Если ваш агент должен быть стабильным помощником в продуктивной среде, связка с OpenAI API, Anthropic, Gemini или OpenRouter может дать более предсказуемое качество. Здесь важно помнить про стоимость: цены и лимиты актуальны на дату публикации и меняются.

В OpenClaw удобно держать несколько providers и переключать их в зависимости от задачи. Например, локальная модель отвечает на бытовые вопросы и команды, а облачная — на запросы уровня «сгенерируй Docker Compose», «разбери логи» или «подготовь архитектурную заметку». Это снижает расход токенов и уменьшает задержку на простых запросах.

Практический паттерн переключения

Хорошая схема — иметь «дефолтный» локальный provider и «fallback» облачный provider. Если локальный ответ слишком долгий, не проходит по контексту или падает по памяти, агент может переключиться на внешнюю модель. Даже если OpenClaw не предоставляет готовую логику fallback в конкретной версии, такой паттерн можно реализовать через настройки, оркестрацию или внешние обвязки.

Skills и MCP: как расширять возможности OpenClaw

Если Gateway и provider делают OpenClaw рабочим, то Skills и MCP делают его полезным в реальной жизни. Skills позволяют добавить собственную бизнес-логику или автоматизацию, а MCP (Model Context Protocol) — подключать внешние инструменты и стандартизированные источники контекста. Для личного ассистента на macOS это означает возможность расти от простого Telegram-бота до полноценного рабочего помощника.

Что дают Skills на практике

Skills — это способ научить агента делать что-то конкретное: читать файлы, обращаться к внутреннему API, формировать отчёты, работать с задачами, запускать скрипты или обращаться к локальным утилитам. Если OpenClaw поддерживает свою систему Skills, обычно она описывает интерфейс, входные данные, права и формат ответа. Это удобно, потому что навыки можно подключать по мере необходимости, а не держать всё в одном монолите.

На практике я рекомендую начинать со Skills с минимальным радиусом действия: например, только чтение конкретной папки или только вызов одного HTTP endpoint. Если сразу дать агенту слишком широкие права, отладка и безопасность резко усложняются. Особенно это критично для macOS-ноутбука, где у вас и личные документы, и рабочие репозитории, и ключи доступа.

MCP как стандарт интеграций

MCP удобен тем, что снижает количество кастомных интеграций на каждый сервис. Вместо того чтобы писать отдельный «костыль» для каждого источника данных, вы подключаете MCP-сервер и даёте агенту стандартизированный доступ к инструментам и контексту. Это особенно полезно, если вы строите экосистему из нескольких внутренних сервисов, заметок, файловых хранилищ и DevOps-инструментов.

Если вы используете MCP, проверяйте, как именно OpenClaw ожидает регистрировать серверы и какие права нужны для запуска. На macOS иногда всплывают проблемы с путями, правами доступа к сокетам и сетевыми ограничениями приложения. Здесь очень помогает логирование: чем прозрачнее запросы агента, тем проще понять, где отвалился контекст.

Безопасная модель расширений

Любой Skill или MCP-коннектор — это дополнительная поверхность атаки. Если агент принимает команды из Telegram, а затем может запускать локальные инструменты, нужно чётко разделить доверенные и недоверенные действия. Для этого полезны allowlist-команды, подтверждение чувствительных операций и отдельные режимы для чтения и записи.

| Риск | Что происходит | Как снизить |

|---|---|---|

| Открытый Gateway | Агент доступен из интернета без контроля | Авторизация, VPN, reverse proxy, ограничение IP |

| Утечка токенов | Секреты попадают в логи или Git | .env, .gitignore, secret manager, ротация ключей |

| Слишком широкие Skills | Агент получает лишние права | Минимальные разрешения и подтверждение действий |

Безопасность, приватность и эксплуатация на Mac

Self-hosted агент даёт контроль, но не снимает ответственность. Если OpenClaw работает на вашем Mac, вы отвечаете за токены, сетевые порты, права на файлы и то, какие данные могут попасть в модель. Приватность здесь — не только про локальную модель, но и про то, как вы храните конфигурации, логи и резервные копии.

Основные правила безопасности

Во-первых, не храните секреты в репозитории. Во-вторых, не публикуйте Gateway без авторизации. В-третьих, разделяйте тестовый и рабочий режим: в тесте можно экспериментировать, в бою нужен контроль доступа и журналирование. И наконец, отдельно проверьте, не пишет ли агент чувствительные данные в лог-файлы в открытом виде.

Если вы используете Telegram, помните: сообщения проходят через стороннюю платформу, а значит часть метаданных уходит за пределы вашей локальной машины. Это не проблема, если вы понимаете модель угроз, но для полностью приватного сценария лучше иметь и локальный интерфейс, и локальный provider. На практике многие используют Telegram только как удобный канал управления, а не как канал для чувствительных данных.

Как отлаживать эксплуатацию

Удобно держать отдельные уровни логов: info для повседневной работы, debug для проблемных сессий и trace только в коротком окне диагностики. При этом нужно помнить о токенах и пользовательских данных в логах. Иногда проще временно отключить подробные логи, чем потом чистить историю и ротацию.

Для macOS полезно также следить за автозапуском, правами на network access и энергосбережением. Если агент должен быть доступен постоянно, ноутбук не должен засыпать без вашей воли. Если это невозможно, лучше перенести OpenClaw на VPS, а Mac оставить как рабочую станцию для управления и разработки.

Типичные ошибки при установке и как их исправлять

Большинство проблем с OpenClaw на macOS укладываются в несколько повторяющихся категорий: неверные переменные окружения, конфликт портов, ошибки сети, несовместимость версий и неправильный provider. Хорошая новость в том, что почти всё это диагностируется за 10–15 минут, если идти по порядку. Плохая новость в том, что новички часто пытаются чинить всё сразу и теряют нить.

Частые ошибки и способы диагностики

| Ошибка | Симптом | Что делать |

|---|---|---|

| Неверный API key | 401/403, модель не отвечает | Проверить `.env`, пробелы, кавычки, ротацию ключа |

| Неверный base URL | Connection refused, timeout | Проверить адрес Ollama/OpenAI-compatible endpoint |

| Порт занят | Address already in use | Найти процесс через lsof, сменить порт |

| Telegram pairing не проходит | Бот молчит, нет апдейтов | Проверить токен, режим webhook/polling, chat ID |

| Ollama не отвечает | Локальная модель висит или падает | Проверить ресурсы Mac, модель, RAM, логи Ollama |

| Skills не загружаются | Функциональность недоступна | Проверить путь, формат манифеста, права доступа |

Команды для быстрой проверки

Перед глубоким дебагом проверьте базовую сетевую доступность и процессы:

lsof -i :<port>

curl http://localhost:<port>/health

env | grep -E 'OPENAI|ANTHROPIC|GEMINI|OPENROUTER|OLLAMA|TELEGRAM'

docker ps

ps aux | grep -i ollamaЕсли агент запускается, но не отвечает в Telegram, сначала убедитесь, что сам Gateway живой и видит provider. Затем проверьте, доходят ли сообщения до бота, и только после этого смотрите логи model routing. Такой порядок кажется банальным, но именно он сокращает время диагностики в разы.

Когда переходить с macOS на VPS

Если OpenClaw нужен как круглосуточный сервис, MacBook не всегда лучший хост: он засыпает, обновляется, меняет сеть и зависит от питания. В этом случае логично перенести Gateway и основную логику на VPS, а macOS оставить для разработки и администрирования. VPS особенно полезен, если Telegram должен отвечать постоянно, а Gateway доступен через стабильный домен.

Но если ваш приоритет — приватность, быстрые локальные тесты и контроль над железом, macOS остаётся отличной платформой для старта. Многие рабочие сценарии вообще не требуют отдельного сервера: достаточно локального OpenClaw, Ollama и Telegram-бота для личного доступа.

OpenClaw vs альтернативы: когда выбирать именно эту связку

На рынке уже есть множество платформ для агентов и чат-обвязок, поэтому вопрос не в том, «есть ли альтернатива», а в том, насколько OpenClaw подходит под ваш сценарий. Его сильная сторона — self-hosted подход, расширяемость, возможность подключать несколько провайдеров и строить приватный рабочий инструмент. Если вам нужен именно управляемый стек, а не SaaS без тонкой настройки, это важное преимущество.

Когда OpenClaw сильнее типового чат-бота

Обычный бот в Telegram отвечает на сообщения, но редко умеет масштабироваться до полноценного агентного слоя. OpenClaw интересен там, где важны Gateway, Skills, multiple providers, локальные модели, интеграции через MCP и контроль доступа. Это уже ближе к платформе, чем к одному конкретному приложению.

По сравнению с «одиночными» решениями, OpenClaw позволяет собрать более зрелую архитектуру: один канал связи, несколько источников LLM, расширяемые навыки и собственный режим эксплуатации. Это особенно хорошо работает для тех, кто любит понимать, где лежит логика, как она запускается и как её обновлять через GitHub/npm/Docker.

Когда проще взять более простое решение

Если вам нужен просто чат с моделью без интеграций, OpenClaw может оказаться избыточным. В таком случае проще использовать готовый SaaS или одну локальную оболочку поверх модели. Но если вы строите личного ассистента как инфраструктуру, а не как игрушку, OpenClaw выглядит разумным выбором.

Часто задаваемые вопросы

Как установить OpenClaw на macOS?

Обычно используют один из трёх путей: GitHub-репозиторий, npm/CLI или Docker. Сначала ставят зависимости вроде Node.js, Git и при необходимости Docker, затем копируют `.env.example` в `.env` и настраивают провайдеры и Gateway по README проекта.

Что выбрать для OpenClaw: Ollama или OpenAI API?

Если важны приватность и локальный запуск, начните с Ollama. Если нужна более высокая стабильность качества и сложные задачи, подключайте OpenAI API, Anthropic, Gemini или OpenRouter; цены и условия использования актуально проверять в официальной документации.

Как работает pairing с Telegram в OpenClaw?

Pairing — это сопряжение Telegram-бота или канала с вашим агентом через токен, chat ID и настройки интеграции. Обычно вы создаёте бота через BotFather, добавляете токен в конфигурацию, включаете Telegram-канал в OpenClaw и проверяете логи Gateway.

Почему OpenClaw не отвечает, хотя сервис запущен?

Чаще всего проблема в неверном API key, неправильном base URL, занятом порте или недоступном provider. Сначала проверьте `.env`, затем доступность локального или облачного endpoint, и только потом логи самого агента и Telegram.

Можно ли использовать OpenClaw как локального ассистента без интернета?

Да, если вы используете локальную модель через Ollama и не подключаете облачные API или внешние каналы. Но для Telegram и некоторых MCP-интеграций интернет всё равно потребуется, поэтому лучше сразу понимать, какие части стека должны оставаться офлайн.

Что такое Gateway в OpenClaw?

Gateway — это точка входа для управления агентом: через него обычно проходят запросы, маршрутизация и внешние подключения. Конкретные возможности зависят от версии OpenClaw, поэтому лучше сверяться с официальной документацией и релиз-нотами.

Как безопасно хранить токены для OpenClaw на macOS?

Лучше хранить секреты в `.env`, исключить его из Git и при необходимости использовать менеджер секретов или системные механизмы macOS. Не вставляйте токены в код и не публикуйте их в открытых логах; если ключ утёк, сразу делайте ротацию.

Заключение

OpenClaw на macOS — это практичная база для личного ИИ-ассистента, если вам нужен контроль над данными, гибкий выбор моделей и возможность расширять агента через Skills и MCP. Самая рабочая стратегия обычно не самая сложная: сначала локальный запуск, затем один provider, затем Telegram, потом расширения и только после этого внешний доступ. Такой подход экономит время, снижает число ошибок и помогает понять архитектуру системы.

Если вы строите Open Felix MacOS как долгоживущий инструмент, относитесь к нему как к сервису: следите за логами, обновлениями, токенами и правами доступа. Проверьте актуальную документацию OpenClaw, изучите README и релизы в репозитории, а затем уже добавляйте новые навыки и каналы. Читать дальше в блоге про OpenClaw