AI Агенты -

OpenClaw: что это за ИИ-агент и как им пользоваться в 2026 году

OpenClaw — это self-hosted ИИ-агент для личного и командного использования, который обычно разворачивают на своём сервере, ПК или VPS и подключают к Telegram, локальным и облачным LLM-провайдерам, а также к внешним инструментам через Skills и MCP. Если вам нужен управляемый агент

OpenClaw — это self-hosted ИИ-агент для личного и командного использования, который обычно разворачивают на своём сервере, ПК или VPS и подключают к Telegram, локальным и облачным LLM-провайдерам, а также к внешним инструментам через Skills и MCP. Если вам нужен управляемый агент с акцентом на приватность, контроль над данными и гибкую интеграцию, OpenClaw — один из самых практичных вариантов, который стоит рассмотреть в 2026 году.

Ниже я покажу, как подойти к установке на Windows, macOS и Linux, когда использовать Docker, как подключить Telegram через pairing (сопряжение с Telegram), какие провайдеры моделей обычно подключают через Gateway (точка входа для управления агентом), и где чаще всего ломается конфигурация: токены, сетевые порты, переменные окружения, доступ к Ollama и ошибки MCP. Версии ПО, доступность функций и цены API указывайте с оговоркой «актуально на дату публикации, проверьте в официальной документации».

Что такое OpenClaw и зачем он нужен: кратко, по делу, без маркетинга

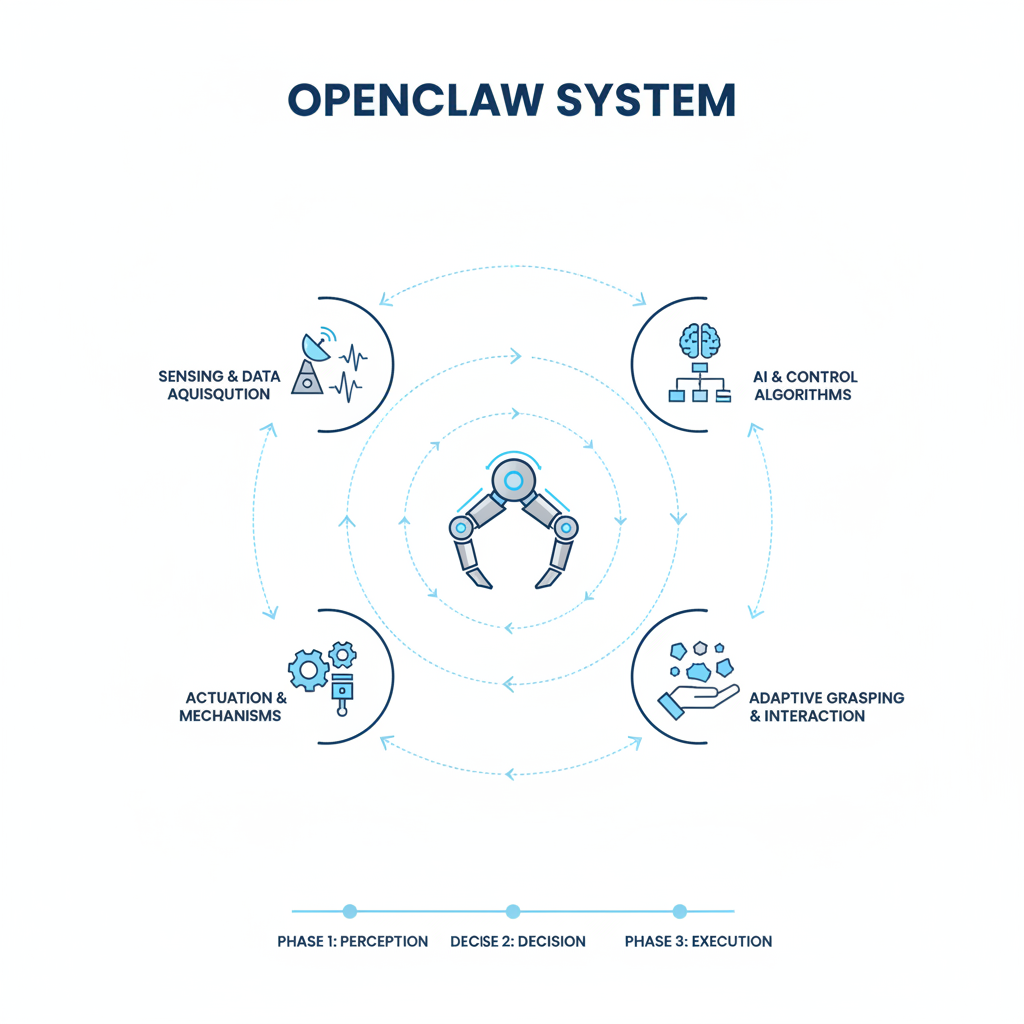

OpenClaw — это не просто чат с моделью, а оболочка для построения личного ИИ-агента, который умеет принимать запросы, выбирать провайдера LLM, выполнять действия через навыки и взаимодействовать с внешними системами. На практике это удобно, когда вы хотите, чтобы ассистент жил у вас на сервере, отвечал в Telegram, работал с локальной моделью через Ollama и при необходимости подключал облачные API вроде OpenAI, Anthropic, Google Gemini или OpenRouter.

Главная идея таких систем — отделить интерфейс общения от «мозга» и от интеграций. Gateway в этом контексте — точка входа для управления агентом: через неё проходят запросы, маршрутизация к модели, авторизация и иногда административные операции. Если у проекта есть CLI, веб-интерфейс и Telegram-канал взаимодействия, это обычно означает, что вы можете использовать один и тот же агент и локально, и удалённо, не переписывая логику под каждый сценарий.

Для кого OpenClaw подходит лучше всего

OpenClaw особенно полезен разработчикам, энтузиастам self-hosted решений, администраторам VPS и тем, кто хочет хранить историю общения и интеграции у себя, а не в чужом SaaS. Если вам важны контроль над токенами, возможность переключаться между локальными и облачными моделями, а также расширяемость через Skills и MCP, это как раз тот класс инструментов, который стоит изучать.

На практике OpenClaw хорошо вписывается в сценарии «личный ассистент для задач и заметок», «Telegram-бот для оперативных команд», «локальный агент для документов» и «гибридная схема: Ollama дома, облачный провайдер на тяжёлые запросы». Но нужно понимать: чем больше интеграций, тем важнее аккуратная настройка окружения, секретов и сетевого доступа.

Чем OpenClaw отличается от обычного чат-бота

Обычный чат-бот часто ограничен одним интерфейсом и одним провайдером модели. OpenClaw и похожие self-hosted агенты ценны тем, что позволяют выстраивать слой оркестрации: выбрать модель под задачу, подключить инструмент, дать агенту ограниченный доступ к внешним сервисам и вести управление через удобный канал, например Telegram.

Это особенно заметно, когда нужно не просто «поговорить», а автоматизировать повторяющиеся действия. Тогда Skills становятся прикладным уровнем системы: один навык может отправлять уведомления, другой — читать задачи, третий — обращаться к API. MCP (Model Context Protocol) в этой схеме полезен как стандартный способ подключать инструменты и сервисы, если поддержка в проекте реализована или планируется.

Как установить OpenClaw на Windows, macOS и Linux

Установка OpenClaw обычно сводится к одному из двух путей: через Docker для предсказуемого запуска или через npm/локальный запуск, если проект это поддерживает и вам нужен более тонкий контроль. На практике Docker чаще удобнее для VPS и серверов, а локальная установка полезна для отладки, разработки Skills и быстрого тестирования конфигурации.

Перед началом проверьте базовые требования: актуальную версию Node.js, npm или pnpm, если проект использует JS-экосистему; Docker и Docker Compose, если выбран контейнерный сценарий; доступ к API-ключам провайдеров; свободный порт для Gateway; а также место на диске, если планируете хранить логи, историю и локальные модели Ollama. Версии и зависимости проверяйте в официальной документации OpenClaw и репозитории GitHub.

Быстрый чек-лист перед установкой

| Параметр | Что проверить | Зачем это нужно |

|---|---|---|

| ОС | Windows 11 / macOS / Linux | Понимать, как запускать сервис и где хранить конфиги |

| Node.js / npm | Совместимая версия из README | Если проект ставится через пакетный менеджер |

| Docker | Docker Engine и Compose | Упрощает запуск на сервере и локально |

| LLM API | OpenAI, Anthropic, Gemini, OpenRouter или Ollama | Нужен хотя бы один источник моделей |

| Telegram | Bot token и доступ к webhook/polling | Для сопряжения с Telegram |

Установка через Docker: самый предсказуемый путь

Если проект OpenClaw поддерживает контейнерный запуск, Docker — первый вариант, который я рекомендую для VPS и домашних серверов. Контейнер упрощает обновления, снижает риск конфликтов зависимостей и позволяет быстро откатиться к предыдущему образу, если новая версия ведёт себя нестабильно.

Типовой сценарий выглядит так: клонируете репозиторий с GitHub, проверяете файл окружения, запускаете контейнеры через Docker Compose и смотрите логи. Команды будут зависеть от конкретного репозитория, но логика почти всегда одинаковая:

- Склонировать репозиторий.

- Скопировать пример конфигурации, например

.env.exampleв.env. - Заполнить ключи провайдеров, адрес Gateway и параметры Telegram.

- Запустить

docker compose up -d. - Проверить логи и доступность веб-интерфейса или API.

Если контейнер не стартует, чаще всего виноваты: неверный .env, занятый порт, ошибка в имени образа или несовместимая версия Docker Compose. На практике полезно первым делом смотреть docker logs и убедиться, что Gateway поднялся именно на том порту, который вы указали в конфиге.

Локальная установка на Windows, macOS и Linux

Локальный запуск удобен, когда вы отлаживаете Skills, тестируете Telegram pairing или подключаете новый провайдер LLM. На Windows обычно используют PowerShell, WSL2 или Docker Desktop; на macOS — Homebrew и контейнеры; на Linux — нативную установку через Node.js или Docker, в зависимости от рекомендаций проекта.

Если OpenClaw распространяется как npm-пакет или имеет CLI, то последовательность обычно следующая: установить зависимости, запустить команду инициализации, затем стартовать агент. Примерно так это может выглядеть в общем виде:

git clone https://github.com/<org>/openclaw.git

cd openclaw

cp .env.example .env

npm install

npm run build

npm startКонкретные команды зависят от репозитория, поэтому сверяйтесь с README. На практике локальная установка чаще ломается из-за версий Node.js: если проект ожидает современный runtime, а у вас установлен старый LTS, получите странные ошибки на этапе сборки или запуска.

Системные требования: не только CPU и RAM

Для агента важны не только оперативная память и процессор, но и качество сети, стабильность DNS, наличие свободного порта, а также место под логи и кеши. Если вы планируете держать Ollama локально, учитывайте и требования самой модели: для больших моделей потребуется заметно больше RAM и, возможно, GPU.

На практике я рекомендую начинать с минимальной, но устойчивой конфигурации: 2 vCPU, 4–8 ГБ RAM для лёгкого сценария с облачным LLM, и отдельный запас по диску для истории и временных файлов. Для Ollama и более тяжёлых локальных моделей запас лучше делать с большим комфортом, иначе агент будет «живым», но медленным.

Настройка Gateway, переменных окружения и провайдеров LLM

Если упростить до сути, Gateway — это точка входа, через которую OpenClaw получает запросы, маршрутизирует их к провайдеру и возвращает ответ пользователю или в Telegram. Правильная настройка Gateway определяет почти всё: безопасность, маршрутизацию, доступ к логам и удобство отладки. В 2026 году гибридная схема «локальный Ollama + облачный fallback» остаётся одной из самых практичных.

Переменные окружения обычно хранятся в .env или аналогичном файле. Там указывают порт, хост, секреты Telegram, ключи API и, возможно, дефолтного провайдера. Никогда не публикуйте реальные токены в GitHub, даже если репозиторий приватный: утечки из истории коммитов и CI встречаются чаще, чем кажется.

Какие провайдеры моделей обычно подключают

| Провайдер | Сильные стороны | Ограничения | Когда брать |

|---|---|---|---|

| Ollama | Локальность, приватность, контроль | Требует ресурсов, скорость зависит от железа | Для домашнего сервера и конфиденциальных задач |

| OpenAI API | Качество, зрелая экосистема | Зависимость от облака и биллинга | Когда нужен сильный универсальный LLM |

| Anthropic | Хорошо для длинного контекста и рассуждений | Тоже облако, цены и лимиты меняются | Для аналитики, текста и сложных диалогов |

| Google Gemini | Интеграции, сильные мультимодальные сценарии | Зависимость от политики доступа и региона | Для мультимодальных и облачных сценариев |

| OpenRouter | Единый шлюз к множеству моделей | Дополнительный посредник и биллинг | Когда нужно быстро переключать модели |

Пример логики конфигурации .env

Точный список переменных зависит от версии OpenClaw, поэтому ориентируйтесь на README, но логика обычно похожа на следующую: указываете адрес Gateway, токен Telegram-бота, дефолтный провайдер и ключи выбранных API. Часто отдельно задают имя модели по умолчанию, таймауты запросов и уровень логирования.

# Псевдопример, названия переменных сверяйте с документацией проекта

PORT=3000

HOST=0.0.0.0

TELEGRAM_BOT_TOKEN=xxx

DEFAULT_PROVIDER=ollama

OLLAMA_BASE_URL=http://localhost:11434

OPENAI_API_KEY=xxx

ANTHROPIC_API_KEY=xxx

GEMINI_API_KEY=xxx

OPENROUTER_API_KEY=xxx

LOG_LEVEL=infoЕсли OpenClaw поддерживает приоритет провайдеров или fallback-цепочку, это очень полезная функция. На практике схема «сначала локальная модель, при нехватке контекста или качества — облачный провайдер» экономит бюджет и повышает устойчивость: агент продолжает работать даже при сбое одного сервиса.

Подключение Ollama: локальный мозг для приватных задач

Ollama — один из самых удобных способов запускать локальные модели на своём компьютере или сервере. Для OpenClaw это особенно полезно, если вы не хотите отправлять чувствительные данные в облако или вам нужен полностью автономный сценарий. Обычно достаточно поднять Ollama, скачать модель и прописать её адрес в конфиге агента.

Типовой рабочий процесс такой: ставите Ollama, запускаете сервис, выполняете ollama pull <model>, проверяете доступность API, затем в OpenClaw указываете base URL и имя модели. На практике часто забывают про то, что локальная модель может быть доступна только на localhost; если OpenClaw запущен в Docker, ему потребуется сетевой адрес контейнера или проброс хоста, а не просто 127.0.0.1.

Telegram, pairing и каналы: как сделать агента доступным в мессенджере

Telegram — один из самых удобных каналов для личного ИИ-ассистента, потому что он всегда под рукой и не требует отдельного приложения. Pairing (сопряжение с Telegram) обычно означает связку вашего Telegram-бота с инстансом OpenClaw, чтобы вы могли общаться с агентом через чат, группы или каналы, если это поддерживается конфигурацией проекта.

Важно различать публичного бота и личный доступ. Для приватного ассистента правильнее ограничивать список разрешённых пользователей, использовать уникальный токен и не давать агенту общаться с кем попало. Если OpenClaw умеет фильтрацию по chat_id, user_id или отдельный whitelist, включайте это сразу, а не «потом».

Как обычно подключают Telegram-бота

Процедура стартует в BotFather: создаёте бота, получаете токен, указываете его в переменных окружения и запускаете OpenClaw. Дальше проект либо начинает long polling, либо требует webhook — это зависит от реализации. Если в документации упомянуты webhooks, вам понадобится HTTPS и публичный домен; если используется polling, запуск проще, но чуть менее гибок для продакшна.

- Создайте бота в BotFather.

- Получите токен и добавьте его в

.env. - Укажите разрешённые чаты или пользователей, если это поддерживается.

- Запустите OpenClaw и проверьте входящие сообщения.

- Отправьте тестовую команду и изучите логи Gateway.

Что важно в каналах, группах и приватных чатах

Если вы подключаете агент не только к личному чату, но и к группе или каналу, сразу продумайте правила доступа. Группа — это место, где риск случайного срабатывания выше: кто-то может упомянуть бота, переслать ему чувствительные данные или спровоцировать действие через вложенный промпт. Для личного ассистента лучше сначала отладить приватный чат, а уже потом расширять сценарий.

На практике полезно разделять режимы: «только ответ в личку», «ответы в группе по команде», «команды администратора через whitelist». Это снижает количество случайных вызовов и помогает держать историю общения в порядке.

Типовые проблемы Telegram pairing

Самые частые ошибки: неверный токен, бот не имеет прав в группе, webhook не доступен извне, порт закрыт firewall’ом или Telegram не может достучаться до HTTPS-адреса. Если у вас локальный запуск, polling обычно проще; если VPS и домен — можно настраивать webhook, но придётся корректно настроить reverse proxy, сертификат и маршрут до Gateway.

| Ошибка | Причина | Что сделать |

|---|---|---|

| Бот молчит | Неверный токен или не запущен polling/webhook | Проверить .env и логи Gateway |

| Не отвечает в группе | Нет прав или не настроен whitelist | Добавить бота и разрешить нужный чат |

| Webhook не работает | Нет HTTPS/домен недоступен | Использовать reverse proxy и валидный TLS |

| Команды срабатывают всем | Нет ограничения по пользователям | Ограничить доступ в конфиге |

Skills и MCP: как расширять OpenClaw без хаоса

Skills — это прикладные модули, которые дают агенту конкретные действия: отправить уведомление, прочитать файл, создать заметку, дернуть API, проверить задачу, вызвать внешнюю службу. В хорошей архитектуре Skills не смешиваются с базовой логикой чата, а подключаются как расширение, чтобы агент оставался управляемым и безопасным.

MCP, если он поддерживается в вашем стеке, помогает стандартизировать подключение инструментов и сервисов. Это особенно удобно, когда вы хотите использовать один и тот же набор инструментов с разными агентами или постепенно переносить интеграции с самописных скриптов на более формальный интерфейс. Однако не стоит ожидать магии: MCP упрощает совместимость, но не снимает обязанность проверять права доступа и формат данных.

Какие навыки полезно сделать в первую очередь

- Отправка уведомлений в Telegram по событию.

- Чтение и запись заметок в локальную папку или хранилище.

- Поиск по задачам и проектам через API.

- Запуск безопасных административных проверок.

- Интеграция с GitHub для статуса репозитория или issues.

На практике лучший первый Skill — максимально простой и предсказуемый. Например, не «автоматически делай всё», а «добавь текст в журнал» или «отправь сообщение только в мой чат». Когда базовый цикл работает стабильно, вы добавляете более сложные действия, логирование и проверки прав.

Как не превратить Skills в источник рисков

Любая возможность выполнять действия от имени пользователя — это потенциальная точка атаки. Если агент может работать с файлами, GitHub, внешними API или MCP-серверами, ограничивайте доступ минимумом привилегий. Не храните секреты прямо в коде, разделяйте роли, а для опасных операций добавляйте подтверждение человеком.

Практический подход к архитектуре расширений

Я рекомендую разделять навыки на три слоя: безобидные чтения, полуавтоматические действия и опасные операции. Чтение можно включать по умолчанию, полуавтоматические операции — только через явное подтверждение, опасные — через ручное разрешение и отдельные секреты. Такая схема хорошо работает и в домашнем агенте, и в корпоративной среде.

Если OpenClaw поддерживает подключение к MCP-серверам, начните с одного источника и одного инструмента. Не стоит сразу вешать десять интеграций: отладка станет слишком сложной, и вы не поймёте, где именно возникла ошибка — в модели, Gateway, Skill или внешнем сервисе.

Безопасность, приватность и эксплуатация на VPS

Безопасность в self-hosted ИИ-агенте — это не дополнительная опция, а часть базовой эксплуатации. Даже если OpenClaw работает только для вас, у него есть токены, потенциальный доступ к Telegram, истории запросов и, возможно, интеграции с внешними API. Если всё это оставить без защиты, вы получите не ассистента, а удобный способ утечек.

При запуске на VPS полезно сразу продумать reverse proxy, TLS-сертификаты, firewall, резервное копирование конфигурации и логи аудита. Если Gateway доступен извне, убедитесь, что он закрыт авторизацией или привязан к защищённому каналу. Для Telegram обычно достаточно исходящих соединений, но webhook может потребовать входящий HTTPS-доступ.

Базовый набор защитных мер

- Хранить токены в

.envили секрет-хранилище, а не в коде. - Ограничить доступ к Gateway по IP, VPN или auth-прокладке.

- Включить whitelist для Telegram-бота.

- Разделить права на чтение и выполнение действий.

- Регулярно обновлять OpenClaw, Docker-образы и зависимости.

Что делать с логами и историей

Логи полезны для отладки, но в них часто попадают токены, email, URL и фрагменты запросов. Настраивайте уровень логирования так, чтобы сохранять диагностику, но не публиковать чувствительные данные. Если проект поддерживает редактирование секретов в логах, включите эту функцию сразу.

История диалогов — отдельный вопрос приватности. На практике удобно хранить её локально для поиска и контекста, но нужно понимать последствия: при компрометации хранилища злоумышленник увидит не только сообщения, но и структуру ваших задач, интересов и иногда конфигурационные подсказки.

VPS: когда лучше, чем домашний сервер

VPS удобен, когда нужен стабильный внешний адрес, домен и доступность Telegram webhook без плясок с NAT. Домашний сервер удобнее для приватности и локальных моделей, особенно если Ollama работает на вашей машине и не должен светиться наружу. На практике гибридная схема — домашний Ollama и VPS с Gateway — возможна, но требует аккуратного сетевого дизайна.

Сравнение OpenClaw с альтернативами: когда он выигрывает, а когда нет

OpenClaw стоит оценивать не как замену всем ИИ-сервисам, а как инструмент для self-hosted управления агентом. Если вам нужен полностью готовый облачный чат без инфраструктуры, проще взять SaaS-решение. Если же нужен контроль, Telegram, локальные модели, кастомные Skills и возможность развивать систему у себя, OpenClaw выглядит гораздо интереснее.

В сравнении с чисто облачными ассистентами OpenClaw выигрывает в приватности и гибкости. В сравнении с автоматизацией уровня n8n он выигрывает там, где нужен именно LLM-агент, а не просто сценарные интеграции. Но если вам нужен огромный рынок готовых плагинов, универсальные корпоративные коннекторы и минимальная возня с инфраструктурой, могут оказаться удобнее другие платформы.

Кому OpenClaw подходит лучше, чем облачный чат

Если вы работаете с личными документами, закрытыми проектами, внутренними заметками или хотите держать ассистента на собственном сервере, OpenClaw — рациональный выбор. Он особенно хорош, когда нужна связка «Telegram + локальная модель + выбор облачного провайдера по необходимости».

Когда лучше выбрать альтернативу

Если вы не хотите заниматься Docker, переменными окружения, токенами и мониторингом сервера, лучше взять более простой облачный инструмент. Если вам нужна строгая бизнес-автоматизация с десятками SaaS-коннекторов, то специализированные платформы интеграции могут быть практичнее. Выбор здесь не про «лучше вообще», а про «лучше для вашей операционной модели».

Типичные ошибки, отладка и рабочая методика поиска проблем

Большая часть проблем с OpenClaw не связана с ИИ как таковым. Обычно ломается инфраструктура: неправильный порт, не тот URL, отсутствующий токен, конфликт версий, закрытый firewall или недоступный локальный сервис. Хорошая новость в том, что такие ошибки предсказуемы и почти всегда диагностируются по логам.

Рабочая методика проста: проверяйте слой за слоем, от внешнего интерфейса к провайдеру. Сначала доступность процесса, затем Gateway, затем Telegram, затем LLM API, затем Skills и MCP. Если сразу лезть в код, можно потерять час там, где проблема решается одной строкой в .env.

| Симптом | Вероятная причина | Проверка | Решение |

|---|---|---|---|

| Агент не отвечает | Gateway не запущен | Порт, логи, health-check | Запустить сервис и проверить конфиг |

| Telegram не приходит | Неверный токен или webhook | BotFather, URL, HTTPS | Исправить токен или перейти на polling |

| Ошибка провайдера | Нет ключа API или лимит | Переменные окружения, биллинг | Добавить ключ или сменить модель |

| Ollama недоступна | Неверный host/port | curl к API Ollama | Исправить адрес и сеть Docker |

| Skill не работает | Ошибки в параметрах или правах | Логи, JSON, permissions | Упростить Skill и проверить входные данные |

Минимальный план диагностики

- Проверить, стартует ли процесс OpenClaw без Telegram.

- Убедиться, что Gateway слушает нужный порт.

- Проверить доступ к LLM API или Ollama отдельно.

- Подключить Telegram и отправить тестовое сообщение.

- Добавлять Skills и MCP только после базовой стабилизации.

Команды и проверки, которые полезно держать под рукой

Набор команд зависит от вашей установки, но логика универсальна: посмотреть логи контейнера, проверить переменные окружения, протестировать локальный endpoint, убедиться в сетевой доступности и повторить запрос с минимальным промптом. Если есть CLI, используйте его для простого health-check и вывода конфигурации, но не публикуйте секреты в stdout.

docker ps

docker logs -f openclaw

curl http://localhost:3000/health

curl http://localhost:11434/api/tagsЕсли ответ от Ollama есть, а OpenClaw всё равно жалуется на провайдера, обычно проблема в адресе, формате модели или окружении контейнера. Если Telegram не отвечает, а локальный интерфейс работает, ищите проблему в токене, вебхуке или правах бота. Такой пошаговый подход экономит время лучше любой «интуиции».

FAQ: часто задаваемые вопросы про OpenClaw

OpenClaw — это локальный ИИ-агент или облачный сервис?

OpenClaw обычно используют как self-hosted решение: вы разворачиваете его на своём компьютере, сервере или VPS и сами выбираете провайдеров LLM. Это даёт больше контроля над данными и интеграциями, чем у чисто облачного сервиса. Актуально на дату публикации, проверьте детали в официальной документации.

Как подключить OpenClaw к Telegram?

Обычно нужно создать бота в BotFather, получить токен и добавить его в переменные окружения OpenClaw. После этого настраивают polling или webhook, в зависимости от того, что поддерживает текущая версия проекта. Для приватного ассистента обязательно ограничьте доступ по пользователям или chat_id.

Можно ли использовать OpenClaw с Ollama?

Да, если в текущей сборке проекта предусмотрена поддержка Ollama или OpenAI-compatible API. На практике это один из самых удобных сценариев: локальная модель остаётся у вас, а OpenClaw выступает как оркестратор. Проверьте адрес сервиса, порт и сетевой доступ из Docker-контейнера.

Что лучше выбрать: OpenAI API, Anthropic, Gemini или OpenRouter?

Если вам нужна простота и широкая поддержка, OpenAI API и OpenRouter часто начинают список. Для длинных рассуждений и текста многие рассматривают Anthropic, а Gemini полезен в мультимодальных сценариях. Выбор зависит от качества, бюджета и региона; цены и лимиты проверьте в официальных тарифах.

Почему OpenClaw не отвечает в Telegram, хотя локально всё работает?

Чаще всего причина в токене бота, webhook/polling или ограничениях сети. Для webhook нужен доступный HTTPS-адрес, а для polling — корректно запущенный процесс и отсутствие блокировок. Проверьте логи Gateway и настройки Telegram по шагам.

Безопасно ли открывать Gateway OpenClaw в интернет?

Только если вы понимаете модель доступа, включили аутентификацию, TLS и ограничения по пользователям или IP. Без защиты Gateway может стать точкой утечки токенов и несанкционированных запросов. Для личного агента безопаснее сначала использовать локальную сеть, VPN или reverse proxy с авторизацией.

Заключение: как начать с OpenClaw без лишней сложности

Если вы хотите личного ИИ-ассистента, который можно контролировать, расширять и запускать на своём железе, OpenClaw — очень здравый кандидат. Самый правильный путь в 2026 году — начать с простого сценария: локальная установка или Docker, одна модель, один канал в Telegram, минимальный набор Skills и только потом переход к MCP, дополнительным провайдерам и продвинутой автоматизации.

На практике лучше всего работает постепенная сборка: сначала убедиться, что Gateway и LLM отвечают, затем подключить Telegram pairing, потом Ollama или облачный провайдер, и только после этого добавлять сложные навыки. Такой подход уменьшает количество ошибок и делает систему понятной в поддержке. Проверьте актуальную документацию OpenClaw, а затем при необходимости посмотрите репозиторий и релизы в GitHub — там обычно быстрее всего появляются важные изменения.

Если хотите продолжить изучение темы, начните с официального README и разделов по установке, Telegram, провайдерам и Skills. Читать дальше в блоге про OpenClaw