AI Агенты -

Опенкло (OpenClaw): что это и как им пользоваться

Опенкло (OpenClaw) — это self-hosted платформа для личных ИИ-ассистентов и агентов, которую можно поднять на своём компьютере, сервере или VPS и связать с Telegram, локальными моделями через Ollama и облачными LLM-провайдерами. Если говорить по-простому, OpenClaw нужен тем, кто х

Опенкло (OpenClaw) — это self-hosted платформа для личных ИИ-ассистентов и агентов, которую можно поднять на своём компьютере, сервере или VPS и связать с Telegram, локальными моделями через Ollama и облачными LLM-провайдерами. Если говорить по-простому, OpenClaw нужен тем, кто хочет управлять ИИ-агентом через свой Gateway (точка входа для управления агентом), подключать Skills, работать с MCP-инструментами и при этом сохранять контроль над данными и окружением.

На практике OpenClaw особенно интересен разработчикам, энтузиастам self-hosted-стека и тем, кто устал от разрозненных скриптов, ручной интеграции Telegram-ботов и постоянной возни с API-ключами. Ниже разберём установку на Windows, macOS и Linux, запуск через Docker, подключение Telegram, настройку провайдеров OpenAI API, Anthropic, Google Gemini, OpenRouter и Ollama, а также типичные ошибки и способы отладки. Версии ПО, цены API и детали конкретных команд актуальны на дату публикации, но перед запуском обязательно проверьте официальную документацию OpenClaw, GitHub-репозиторий и README.

Что такое OpenClaw и кому он подходит

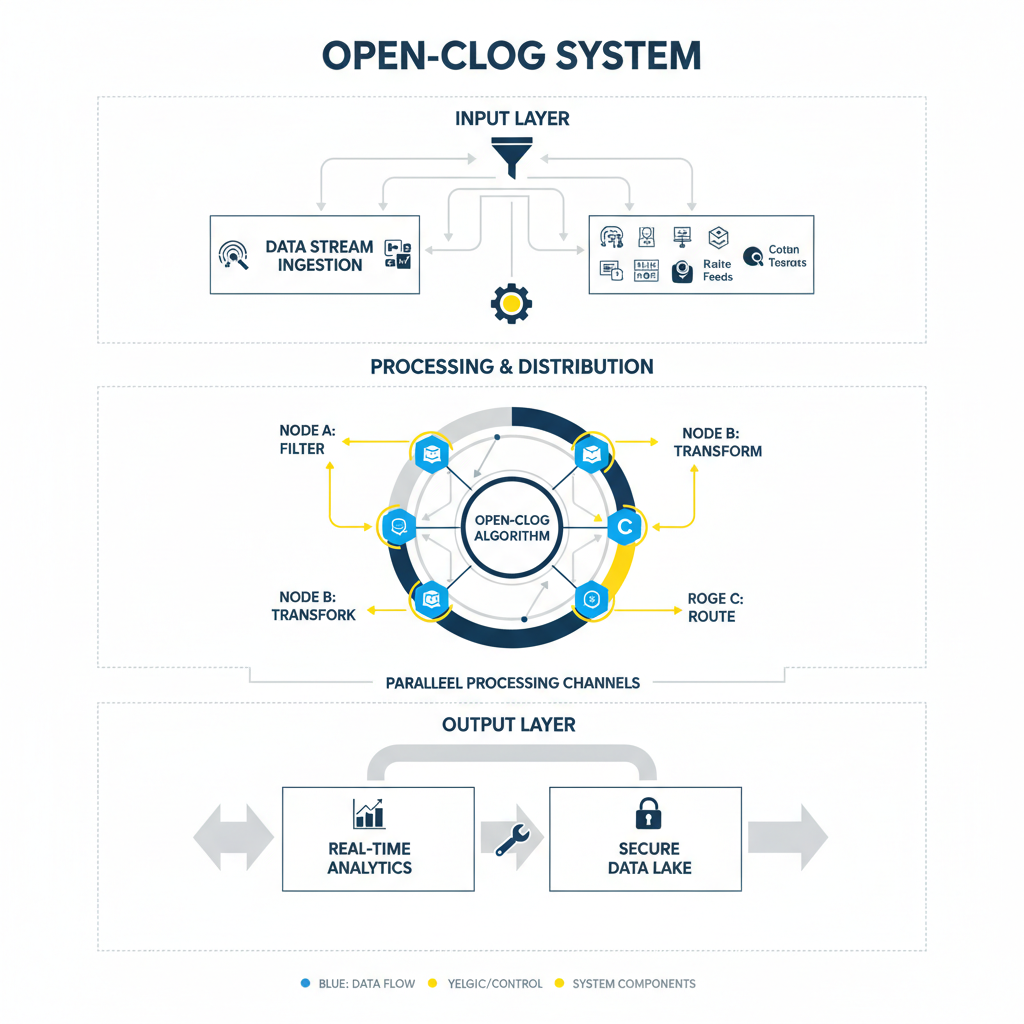

OpenClaw — это не просто «чат с моделью», а каркас для запуска личного ИИ-агента, который может принимать команды, обращаться к инструментам, работать через Telegram и использовать разные модели в зависимости от задачи. В экосистеме таких решений важны три вещи: точка входа (Gateway), слой моделей и слой расширения поведения через Skills и MCP. Именно поэтому OpenClaw чаще всего рассматривают как основу для собственного AI-оператора, а не как очередной веб-чат.

Когда OpenClaw лучше, чем обычный чат-бот

Если вам нужен только диалог с моделью, достаточно интерфейса у провайдера или локального клиента. Но когда требуется связать ИИ с Telegram, файловой системой, GitHub, внешними API, расписанием задач и собственными правилами доступа, удобнее иметь отдельный self-hosted слой. OpenClaw в таком сценарии выступает как управляющая платформа, где можно централизованно задать поведение агента, подключить провайдеров и контролировать, что именно он может делать.

На практике OpenClaw выбирают, когда хочется:

- держать токены и конфигурации у себя, а не в стороннем SaaS;

- подключать несколько LLM-провайдеров и переключаться между ними;

- использовать Telegram как удобный интерфейс доступа;

- добавлять Skills — специализированные действия и сценарии;

- подключать MCP-сервисы для стандартизированного доступа к инструментам.

Для кого эта платформа особенно полезна

OpenClaw хорошо подходит разработчикам, DevOps-инженерам, техническим руководителям, авторам контент-пайплайнов и энтузиастам домашнего ИИ-стека. Если вы уже поднимали Ollama, работали с Docker, пользовались OpenRouter или пробовали собрать Telegram-бота на Node.js, вход будет сравнительно мягким. Если же вы впервые сталкиваетесь с self-hosted-агентами, начните с локального запуска в Docker и только потом переносите систему на VPS.

Что в экосистеме обычно используется вместе с OpenClaw

В реальных развертываниях OpenClaw почти всегда живёт рядом с другим ПО: Ollama для локальных моделей, OpenAI API, Anthropic, Google Gemini и OpenRouter для облачных запросов, Docker для контейнеризации, GitHub для контроля версий, npm для установки зависимостей и MCP для унификации подключаемых инструментов. Такой стек удобно проектировать заранее, чтобы потом не переписывать конфиг под очередной провайдер или интеграцию.

| Сценарий | Кому подходит | Почему удобно |

|---|---|---|

| Локальный запуск на ПК | Энтузиастам и разработчикам | Быстрая проверка без аренды сервера и рисков для данных |

| VPS 24/7 | Тем, кому нужен постоянный доступ | Стабильный Gateway и Telegram-бот без зависимости от домашнего ПК |

| Docker | Практически всем | Изоляция, переносимость, проще обновлять и откатывать |

Установка OpenClaw на Windows, macOS и Linux

Установка OpenClaw обычно сводится к трём вопросам: откуда брать код, как запускать сервис и где хранить конфигурацию. В зависимости от версии проекта это может быть Node.js-приложение, Docker-образ или гибридный вариант, поэтому перед стартом важно свериться с GitHub и README. Ниже — практический маршрут, который помогает избежать большинства типичных ошибок на Windows, macOS и Linux.

Системные требования и базовая подготовка

Для локального запуска обычно нужны современные версии Docker и Docker Compose, а если запускаете из исходников — ещё и Node.js с npm. На практике удобнее всего начинать с контейнера: так проще повторить окружение и не ловить проблемы с несовместимостью библиотек. Если планируете подключать Ollama, заранее проверьте, хватит ли памяти и дискового пространства под модель, особенно на ноутбуке без дискретной GPU.

| Платформа | Рекомендованный способ | Комментарий |

|---|---|---|

| Windows | Docker Desktop или WSL2 | Меньше проблем с путями, сетями и совместимостью зависимостей |

| macOS | Docker Desktop или локальный Node.js | Удобно для тестов, но следите за правами доступа к каталогам |

| Linux | Docker / Docker Compose | Лучший вариант для VPS и домашнего сервера |

Установка через Docker: универсальный сценарий

Для большинства пользователей Docker — самый надёжный способ поднять OpenClaw. Сначала клонируют репозиторий с GitHub, затем настраивают переменные окружения и поднимают контейнеры. Если проект поставляется с docker-compose.yml, обычно достаточно создать .env и выполнить один запуск.

git clone <URL_официального_репозитория>

cd openclaw

cp .env.example .env

docker compose up -d --buildЕсли в README указаны другие команды, используйте именно их. В self-hosted-проектах детали запуска часто меняются: может отличаться имя сервиса, порт Gateway, наличие отдельного контейнера для worker-части или интеграций. После старта проверьте логи, чтобы убедиться, что агент поднялся без ошибок и смог подключиться к выбранному провайдеру.

Установка из исходников через npm

Если проект предполагает запуск без контейнеров, то понадобится Node.js, npm и, возможно, pnpm или yarn — ориентируйтесь на документацию. Обычно схема выглядит так: устанавливаете зависимости, копируете пример конфигурации и запускаете dev или start-скрипт. Такой режим полезен для отладки Skills, экспериментов с кодом и быстрой правки интеграций, но для постоянной работы я всё же рекомендую Docker или отдельный VPS-сервис.

npm install

npm run build

npm run startЧек-лист перед первым запуском

Перед стартом удобно пройтись по короткому чек-листу. Это экономит время, когда вы подключаете Telegram, несколько LLM-провайдеров и локальные модели одновременно. На практике больше всего проблем возникает не из-за самой платформы, а из-за забытых переменных окружения, неправильных URL и сетевых ограничений.

| Проверка | Что должно быть | Зачем |

|---|---|---|

| .env заполнен | Указаны токены и URL | Чтобы Gateway и провайдеры стартовали без ошибок |

| Порт доступен | Нет конфликта с другими сервисами | Чтобы интерфейс и webhook не падали при запуске |

| Логи читаются | Можно смотреть docker logs или journalctl | Чтобы быстро ловить ошибки подключения и авторизации |

Gateway, переменные окружения и базовая конфигурация

Gateway — это точка входа для управления агентом: через него обычно проходят запросы от интерфейса, Telegram и других подключений. Если конфигурация Gateway настроена неправильно, агент может формально стартовать, но не отвечать на сообщения, не принимать команды или падать при обращении к провайдеру. Поэтому именно этот этап чаще всего определяет, будет ли OpenClaw удобным инструментом или вечным источником отладки.

Что обычно задаётся в .env

В переменных окружения, как правило, указывают порт, адрес Gateway, режим логирования, секреты, токены Telegram и ключи провайдеров LLM. Конкретные названия зависят от реализации, поэтому не стоит копировать чужой .env вслепую: проверьте README репозитория и актуальные примеры конфигураций. На практике полезно хранить отдельные профили для локальной машины и VPS, чтобы не путать адреса и ключи.

Типичные категории переменных:

- сетевые — порт, host, base URL;

- безопасность — секреты, токены, подписи webhook;

- LLM — API-ключи, названия моделей, endpoint;

- интеграции — Telegram, MCP, внешние сервисы;

- режим работы — debug, verbose logging, allowed origins.

Как не сломать конфиг при первом запуске

Сначала проверьте, что OpenClaw вообще стартует с минимальным набором переменных. Затем последовательно включайте интеграции и проверяйте логи после каждого шага. Если вы видите ошибку авторизации, сначала проверьте токен, потом адрес endpoint, и только потом ищите проблему в логике Skills или Telegram-сопряжении.

Пример логики конфигурации

Даже если точные имена переменных в вашем релизе отличаются, логика остаётся одинаковой: сначала идентификация сервиса, затем доступ к провайдеру, затем подключение каналов и инструментов. Это особенно важно для Telegram, где webhook и polling требуют разного подхода к сетевой доступности. Если агент работает на VPS за nginx или Caddy, заранее проверьте, что внешние URL корректно проксируются и совпадают с настройками в Telegram.

Подключение Telegram: pairing, каналы и рабочие сценарии

Telegram часто становится самым удобным интерфейсом для личного ИИ-ассистента, потому что он всегда под рукой и не требует отдельного веб-приложения. Pairing (сопряжение с Telegram) обычно означает связывание вашего Telegram-аккаунта или бота с OpenClaw, чтобы агент мог принимать сообщения, отвечать в чатах и, при необходимости, работать в каналах. Если настроить это правильно, Telegram превращается в лёгкий мобильный пульт управления агентом.

Что нужно для подключения Telegram

Сначала обычно создают бота через BotFather, получают токен и добавляют его в конфигурацию OpenClaw. Далее нужно определить, как агент будет получать сообщения: через polling или webhook. Polling проще для локальных тестов, а webhook лучше подходит для VPS с доменом и HTTPS, но требует корректной сетевой конфигурации.

- Создайте бота в Telegram и получите токен.

- Добавьте токен в .env или секреты контейнера.

- Проверьте, какой режим поддерживает ваш релиз OpenClaw: polling или webhook.

- Запустите сервис и посмотрите логи на предмет ошибок авторизации.

- Отправьте тестовое сообщение боту и проверьте ответ.

Каналы, чаты и права доступа

Если OpenClaw поддерживает работу не только в личных чатах, но и в группах или каналах, важно заранее ограничить права. Иначе агент может отвечать там, где это не планировалось, или реагировать на сообщения всех участников. На практике я советую сначала запускать бота только в личном чате, а затем поэтапно включать группы, whitelist пользователей и отдельные правила для каналов.

Полезно сразу продумать:

- кто имеет право писать агенту;

- может ли агент отвечать в группах;

- должен ли бот реагировать на все сообщения или только на команды;

- нужны ли отдельные сценарии для админов и обычных пользователей;

- как логировать действия агента для последующего аудита.

Типовые ошибки при Telegram-подключении

Чаще всего проблемы связаны с неверным токеном, недоступным webhook URL, закрытым портом или конфликтом между несколькими экземплярами бота. Ещё одна распространённая ошибка — одновременный запуск polling и webhook, когда оба режима пытаются читать обновления. Если Telegram-бот «молчит», сначала проверьте простые вещи: токен, сеть, webhook URL, затем переходите к логике OpenClaw.

| Проблема | Вероятная причина | Что делать |

|---|---|---|

| Бот не отвечает | Неверный токен или сервис не запущен | Проверить .env, перезапустить контейнер, посмотреть логи |

| Webhook не принимается | Неверный HTTPS/домен/порт | Проверить reverse proxy и публичную доступность URL |

| Дублируются сообщения | Конфликт polling и webhook | Оставить только один режим получения обновлений |

Провайдеры LLM: Ollama, OpenAI API, Anthropic, Gemini и OpenRouter

Один из главных плюсов OpenClaw — возможность не привязываться к одному источнику моделей. Вы можете использовать локальную Ollama для приватных задач, облачные API для более сильного reasoning и OpenRouter как удобную точку агрегации многих моделей. Такой подход помогает балансировать цену, скорость и приватность, а также не зависеть от одного вендора.

Локальные модели через Ollama

Ollama — это удобный способ держать модели локально и не отправлять чувствительные данные в облако. На практике его используют для черновиков, внутренних заметок, простых вопросов и сценариев, где важна приватность. Если OpenClaw умеет подключаться к Ollama через совместимый endpoint, настройка обычно сводится к указанию адреса сервера и имени модели.

Плюсы локального варианта:

- данные остаются на вашем устройстве или сервере;

- не нужен внешний API-ключ для каждой задачи;

- можно тестировать без расходов на токены;

- удобно для офлайн- или semi-offline-сценариев.

Облачные провайдеры: когда нужен максимум качества

OpenAI API, Anthropic и Google Gemini обычно подключают для более сложных задач: длинного контекста, качественного code reasoning, анализа документов и генерации более аккуратных текстов. OpenRouter удобен тем, что позволяет работать с несколькими моделями через единый API-слой, но перед использованием всё равно стоит проверить тарифы и доступность нужных моделей — актуально на дату публикации, проверьте в официальной документации. Для production-сценариев важно понимать, куда именно уходят данные и какие политики хранения применяет провайдер.

Как выбрать провайдера под задачу

Универсального ответа нет, но есть практичная схема выбора. Для приватных заметок и экспериментального агента берите Ollama, для сложных запросов и продвинутого качества — OpenAI, Anthropic или Gemini, а для гибкого доступа к разным моделям — OpenRouter. Часто оптимальная конфигурация — это комбинация нескольких провайдеров, где локальная модель используется по умолчанию, а облако подключается только когда нужен более высокий уровень ответа.

| Провайдер | Сильная сторона | Ограничение | Рекомендуется для |

|---|---|---|---|

| Ollama | Приватность и локальный контроль | Зависит от вашего железа | Локальные задачи, тесты, черновики |

| OpenAI API | Сильное качество и развитая экосистема | Требует контроля бюджета и токенов | Сложные запросы, production |

| Anthropic | Хороший long-context и аккуратный стиль | Нужно проверять доступность и тарифы | Аналитика, длинные диалоги |

| Google Gemini | Интересен для мультимодальных задач | Требует сверки лимитов и регионов | Разные типы контента и эксперименты |

| OpenRouter | Единый шлюз к множеству моделей | Появляется дополнительный слой зависимости | Гибкое переключение моделей |

Skills, MCP и расширение возможностей OpenClaw

Skills в контексте OpenClaw — это расширения поведения агента, которые позволяют ему выполнять конкретные действия: работать с файлами, вызывать внешние API, запускать сценарии или применять бизнес-логику. MCP (Model Context Protocol) — это стандарт, который помогает подключать инструменты и сервисы более единообразно, не переписывая каждый раз интеграцию под один и тот же паттерн. Вместе они делают OpenClaw не просто чат-обёрткой, а практической платформой для автоматизации.

Когда нужны Skills

Skills особенно полезны, когда ответы модели недостаточно, и нужен реальный action layer. Например, вы хотите, чтобы агент не только объяснял, как оформить отчёт, но и подгружал шаблон, создавал файл, собирал данные из GitHub или запускал внутренний сервис. Такой подход превращает OpenClaw в рабочий инструмент, а не в демонстрацию возможностей LLM.

Хорошая практика — делать Skills узкими и предсказуемыми. Один Skill должен отвечать за одну задачу: чтение файла, обращение к API, проверка статуса сервиса, отправка уведомления. Это облегчает отладку, контроль доступа и последующее тестирование.

Что даёт MCP

MCP помогает стандартизировать подключение внешних инструментов, чтобы агент мог обращаться к ним по понятному контракту. Если ваш OpenClaw умеет работать с MCP-серверами, это сильно упрощает масштабирование: вместо самописных интеграций можно подключать совместимые сервисы и постепенно расширять арсенал агента. На практике MCP особенно полезен там, где есть несколько источников данных и нужно единообразие в описании инструментов.

Как проектировать расширения безопасно

Любой инструмент, который агент может вызвать сам, — это зона риска. Если Skill имеет доступ к файловой системе, командам shell или внутренним API, у него должны быть ограниченные права и понятные входные параметры. Для production-сценариев я рекомендую выносить опасные действия в отдельный слой с подтверждением пользователя, а не давать агенту прямой безусловный доступ ко всему хосту.

Безопасность, приватность и эксплуатация на VPS

Безопасность OpenClaw — это не «дополнительная галочка», а обязательная часть архитектуры. Если вы выносите Gateway в интернет, подключаете Telegram и облачные API, то фактически строите сервис, который может обрабатывать пользовательские данные, секреты и внутренние команды. Значит, нужны минимальные меры защиты: HTTPS, обновления, контроль доступа, разделение окружений и аккуратная работа с токенами.

Почему self-hosted не означает автоматически безопасный

Сам факт, что агент стоит у вас на сервере, ещё не делает его безопасным. Ошибки чаще связаны не с моделью, а с инфраструктурой: открытый порт, слабый пароль, публичный .env, неограниченный Telegram-доступ, незакрытый webhook. На практике большинство инцидентов в self-hosted-проектах происходит из-за неправильного обращения с секретами и отсутствия базовой сетевой гигиены.

Минимальный набор мер защиты

Если поднимаете OpenClaw на VPS, стоит сразу заложить несколько вещей. Используйте reverse proxy с TLS, не публикуйте Gateway без необходимости, храните секреты вне репозитория, обновляйте контейнеры и ограничивайте доступ по IP, если это возможно. Для Telegram желательно иметь whitelist пользователей или хотя бы проверку идентификаторов, чтобы бот не стал публичной игрушкой для всех подряд.

- HTTPS через nginx, Caddy или Traefik;

- изоляция контейнеров и минимум привилегий;

- отдельные ключи для разных окружений;

- логирование без вывода секретов;

- регулярные обновления образов и зависимостей;

- резервные копии конфигурации и важных данных.

Что делать с токенами и логами

Токены Telegram, OpenAI API, Anthropic, Gemini и OpenRouter нельзя хранить в публичных репозиториях или в логах. Если вам нужно дебажить интеграцию, выводите только укороченную версию ключа или последние символы, но не весь секрет. Это простое правило спасает от неприятностей, когда отладочный лог случайно оказывается в issue на GitHub или в общем чатике команды.

Как отлаживать ошибки OpenClaw и находить проблемы быстро

Отладка OpenClaw обычно идёт по одной и той же схеме: проверяем запуск, логи, переменные окружения, сетевые доступы и только потом логику Skills. Такой порядок помогает не терять время на поиск «сложной» причины там, где проблема банальна. На практике 80% ошибок относятся к конфигу, 15% — к сети и авторизации, и только остальные 5% действительно связаны с логикой агента.

Логи как основной инструмент

Если OpenClaw запускается в Docker, первым делом смотрите docker logs. Если сервис работает как системная служба на Linux, используйте journalctl. Не пытайтесь гадать: сообщения об ошибке подключения к провайдеру, неверном endpoint или проблеме с токеном обычно уже есть в логах, просто их нужно прочитать внимательно.

docker logs -f openclaw

journalctl -u openclaw -fПошаговый алгоритм поиска неисправности

- Убедитесь, что контейнер или процесс действительно запущен.

- Проверьте .env и наличие всех обязательных секретов.

- Проверьте доступность провайдера LLM по сети.

- Снимите Telegram-интеграцию и протестируйте локальный ответ.

- Включайте Skills и MCP по одному, а не пачкой.

- Если есть webhook, проверьте HTTPS, домен и reverse proxy.

Таблица типичных ошибок и решений

| Ошибка | Что означает | Практическое решение |

|---|---|---|

| 401 Unauthorized | Неверный API-ключ или токен | Перепроверьте секрет в .env и формат переменной |

| Connection refused | Сервис недоступен по адресу | Проверьте host, port, firewall и контейнерную сеть |

| Webhook timeout | Telegram не может достучаться до сервера | Проверьте HTTPS, домен и публичную доступность URL |

| Skill не выполняется | Проблема в логике или правах доступа | Тестируйте Skill отдельно и ограничьте входные данные |

Сравнение OpenClaw с альтернативами и выбор архитектуры

OpenClaw стоит рассматривать не как замену всем ИИ-сервисам, а как слой управления, который удобно использовать поверх локальных и облачных моделей. В этом его отличие от обычного Telegram-бота на OpenAI API или от чистого веб-интерфейса у провайдера. Если вам нужен контроль, расширяемость и self-hosted-архитектура, OpenClaw часто оказывается практичнее самописного решения.

OpenClaw против самописного бота

Самописный Telegram-бот хорош, когда задача узкая: один чат, один API, один сценарий. Но как только появляются Skills, несколько провайдеров, конфигурация для разных окружений и требования к безопасности, код быстро разрастается. OpenClaw экономит время именно на этой инфраструктурной части: Gateway, интеграции, каналы, расширения и управление поведением агента уже собраны в более цельную систему.

OpenClaw против облачных no-code ассистентов

No-code сервисы удобны для старта, но они часто ограничивают доступ к данным, инструментам и способам деплоя. OpenClaw выигрывает там, где важны приватность, контроль над окружением и возможность доработать поведение под себя. Особенно это заметно, если вы хотите смешивать локальный Ollama, OpenRouter и собственные Skills, а не жить в рамках одного UI.

Когда лучше выбрать другой путь

Если у вас нет желания администрировать сервер, читать логи и хранить ключи аккуратно, возможно, self-hosted-стек вам не нужен. В таком случае проще использовать готовый облачный ассистент или минимальный бот с ограниченным функционалом. OpenClaw имеет смысл тогда, когда вы реально хотите владеть архитектурой и готовы немного инвестировать время в настройку и поддержку.

Часто задаваемые вопросы

Что такое OpenClaw простыми словами?

OpenClaw — это платформа для запуска личного ИИ-агента у себя на сервере или компьютере. Через неё можно подключать Telegram, провайдеров LLM, Skills и MCP-инструменты, чтобы агент не только отвечал, но и выполнял действия.

Как установить OpenClaw на Windows?

На практике проще всего использовать Docker Desktop или WSL2, чтобы избежать проблем с зависимостями и путями. Сначала клонируйте официальный репозиторий, заполните .env по README и запустите docker compose; точные команды проверьте в документации проекта.

Можно ли подключить Ollama к OpenClaw?

Да, если текущая версия OpenClaw поддерживает совместимый endpoint Ollama или локальный провайдер. Обычно достаточно запустить Ollama, указать адрес сервера и имя модели, а затем проверить ответ в логах и в Telegram-тесте.

Как подключить Telegram к OpenClaw?

Обычно создают бота через BotFather, получают токен и добавляют его в конфигурацию. Затем выбирают режим подключения — polling или webhook — и проверяют, что Gateway доступен, если используется webhook. Для личного теста лучше начинать с polling.

Что делать, если OpenClaw не отвечает?

Сначала проверьте логи контейнера или сервиса, затем .env, токены и доступность провайдера LLM. На практике проблема чаще всего оказывается в неверном ключе, недоступном endpoint или конфликте Telegram polling и webhook.

OpenClaw безопасно запускать на VPS?

Да, но только если вы закроете Gateway, включите HTTPS, ограничите доступ и не будете хранить секреты в открытом виде. Self-hosted не означает автоматически безопасно: защита зависит от вашей конфигурации и дисциплины обновлений.

Стоит ли использовать OpenRouter вместо OpenAI API?

OpenRouter удобен, если вам нужен единый доступ к нескольким моделям и гибкое переключение провайдеров. OpenAI API, Anthropic или Gemini могут быть лучше, если вы хотите работать напрямую с конкретным вендором; выбор зависит от задач, бюджета и требований к доступности моделей.

Заключение

Опенкло (OpenClaw) — это практичный путь к собственному ИИ-ассистенту, если вам важны контроль, расширяемость и возможность собрать рабочую систему под свои задачи. Самый разумный старт — локальный запуск в Docker, один провайдер LLM, Telegram в режиме теста и только потом Skills, MCP и VPS-эксплуатация. Такой порядок экономит часы на отладке и помогает понять, где у вас лежит реальная ценность: в приватности, автоматизации или интеграции с личными рабочими процессами.

Если вы планируете внедрять OpenClaw в рабочий контур, не ограничивайтесь только запуском. Проверьте актуальную документацию OpenClaw, README в GitHub, разделы про Gateway, Telegram и провайдеров, а также подпишитесь на релизы в репозитории, чтобы не пропустить изменения конфигурации и совместимости. Для расширения практики и пошаговых разборов можно также Читать дальше в блоге про OpenClaw.